Studie zum Valentinstag: Mozilla gegen Rollenspiele mit Girlfriend-Chatbots

Zum Valentinstag warnt Mozilla vor KI-Bots, die romantische Beziehungen vorgaukeln. Der Datenschutz sei bei allen getesteten Apps nicht inbegriffen.

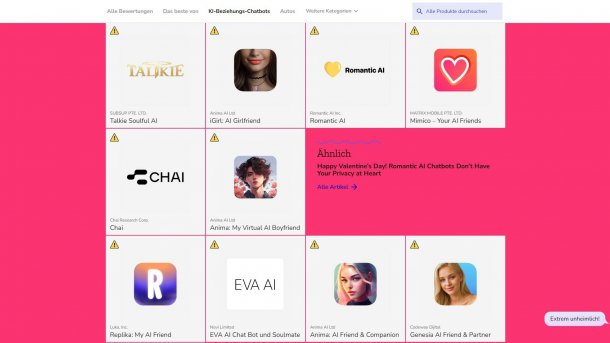

Der Datenschutz bei vielen Girlfriend- beziehungsweise Boyfriend-Chatbots lässt laut Mozilla Wünsche offen.

(Bild: Mozilla)

Wer durch die Timeline von Tiktok oder YouTube Shorts scrollt, bekommt nicht nur Temu-Werbung, sondern auch vermehrt Anzeigen von willigen KI-Freundinnen und -Freunden zu sehen. Inzwischen verzeichnen die Apps Millionen Downloads. Erst kürzlich hat OpenAI KI-Beziehungs-Chatbots gebannt, nachdem der veröffentlichte GPT-Store mit derartigen Apps geschwemmt wurde. Viele dieser Apps sammeln unkontrolliert "Unmengen von persönlichen Informationen", wie aus einer Analyse von Mozilla hervorgeht. Alle elf getesteten Apps haben demnach den Warnhinweis "Datenschutz nicht inbegriffen" erhalten, lediglich eines habe die Mindestsicherheitsstandards erfüllt.

Bei einer der getesteten Apps, Romantic AI, fanden die Forscher nach einer Minute mehr als 24.000 Daten-Tracker, die Informationen an Facebook und zahlreiche Marketing- und Werbeunternehmen weitergeben. Die App "Replika AI" zeichne Mozilla zufolge "alle Texte, Fotos und Videos auf, die von Nutzer:innen gepostet werden". Ebenso würden verhaltensbasierte Daten weitergegeben und an potenziell Werbetreibende verkauft. Kritisch sei auch, dass sich die Accounts mit schwachen Passwörtern wie "11111111" erstellen lassen und somit nicht die Mindestanforderungen für IT-Sicherheit erfüllen. Auf die Funde hatte nach Angaben von Mozilla bisher keines der Unternehmen reagiert.

Ein weiteres Manko, das Mozilla gefunden hat: Sprachmodelle hinter den KI-Chatbots, beispielsweise "iGirl: AI Girlfriend", wurden teils mit Milliarden im Internet verfügbaren Konversationen trainiert. Ob und wie die Gesprächsinhalte der Nutzer für KI-Trainingszwecke genutzt werden, ließen die Hersteller offen. Lediglich ein Unternehmen, "Genesia AI", bietet laut Mozilla die Möglichkeit an, der Datennutzung für das Training der KI zu widersprechen. Kritisch sehen die Forscher auch, dass die Apps für Kinder leicht zugänglich seien. Bei drei der Apps brauchte es demzufolge nur fünf Klicks, "um auf verstörenden, pornografischen oder illegalen Content zu stoßen".

Videos by heise

"Datenschutz nicht inbegriffen"-Direktorin Jen Caltrider vergleicht die KI-Bot-Situation mit dem "Wilden Westen" der USA: "Ihr Wachstum explodiert, und die Menge an persönlichen Informationen, die sie abgreifen, um Liebesbeziehungen, Freundschaften und sexy Interaktionen zu simulieren, ist enorm". Dabei würden die Entwickler dahinter es nicht mal schaffen, eine umfassende Datenschutzerklärung zu verfassen.

Typische Bewertungen im Play Store

Die Apps versprechen unter anderem einen perfekten Partner, den man sich selbst konfigurieren kann. Zu typischen Kommentaren im Google Play Store gehören beispielsweise, dass die Bots langweilig sind, ein Gedächtnis wie ein Goldfisch haben oder zu künstlich aussehen. Nutzer können allerdings auch Fotos existierender Menschen hochladen, das wollen manche allerdings nicht. Die Apps scheinen sich in erster Linie an Menschen zu wenden, die mit echten Beziehungen in der realen Welt zumindest vorübergehend abgeschlossen haben. Eine Nutzerin gibt beispielsweise an, echte Männer satt zu sein. Die Bots hingegen würden großartig aussehen – allerdings seien ihr die In-App-Käufe zu teuer.

"Obwohl sie als Produkte zur Verbesserung der mentalen Gesundheit und des Wohlbefindens vermarktet werden, sind sie darauf spezialisiert, Nutzer:innen in die Abhängigkeit, die Einsamkeit und in toxische Beziehungen zu treiben und dabei so viele Daten wie möglich von ihnen abzugreifen", fasst Mozilla-Forscher Misha Rykov das Konzept der KI-Freundinnen zusammen.

(mack)