Wie Trollfarmen auf Facebook 140 Millionen Amerikaner erreichten

(Bild: Lukasz Stefanski/Shutterstock.com)

Vor der US-Präsidentschaftswahl 2020 wurden die Bürger mit Falschnachrichten in sozialen Netzwerken bombardiert. Facebook tat fast nichts.

Im Vorfeld der US-Präsidentschaftswahlen von 2020, der wohl am härtesten umkämpften in der Geschichte der Vereinigten Staaten, wurden die beliebtesten Facebook-Seiten für christliche und afroamerikanische Inhalte von osteuropäischen Trollfarmen betrieben. Diese Seiten waren Teil eines größeren Netzwerks, das laut einem internen Unternehmensbericht insgesamt fast die Hälfte aller Amerikaner erreichte. Besonders erschreckend: Diese Reichweite wurde nicht durch Aktionen der Nutzer, sondern in erster Linie durch Facebooks eigenes Plattformdesign und Algorithmen erzielt, die hungrig sind auf das sogenannte Engagement – das Liken, Teilen und Kommentieren.

Der Bericht, der schon im Oktober 2019 verfasst wurde und MIT Technology Review von einem ehemaligen Facebook-Mitarbeiter, der nicht an seiner Erstellung beteiligt war, zur Verfügung gestellt wurde, stellt fest, dass es das soziale Netzwerk nach der letzten Wahl 2016 – als Donald Trump Präsident wurde – versäumt hatte, grundlegende Änderungen an der Art und Weise, wie seine Plattform Informationen verarbeitet und verbreitet, zu priorisieren. Stattdessen verfolgte das Unternehmen eine sogenannte Whack-a-mole-Strategie [1], die darin bestand, die Aktivitäten problematischer Akteure zu überwachen und immer erst dann zu unterbinden, wenn sie sich am politischen Diskurs beteiligten – und einige virtuelle Leitplanken einzuführen, die "das Schlimmste vom Schlimmsten" verhinderten.

Trollfarmen erzielten trotzdem große Reichweite

Doch dieser Ansatz half wenig, um das eigentliche Problem einzudämmen, so der Bericht. Trollfarmen bauten nach wie vor ein riesiges Publikum auf, indem sie Netzwerke von Facebook-Seiten betrieben und mit ihren Inhalten 140 Millionen US-Nutzer pro Monat erreichten – 75 Prozent von ihnen waren erstaunlicherweise zuvor nie einer der Seiten gefolgt. Sie sahen die Inhalte, weil das Inhaltsempfehlungssystem von Facebook sie in ihre Newsfeeds hineinschob.

"Anstatt dass die Nutzer sich dafür entscheiden, Inhalte von diesen Akteuren zu erhalten, ist es unsere Plattform, die sich dafür entscheidet, [diesen Trollfarmen] eine enorme Reichweite zu geben", schreibt der Autor des Berichts, Jeff Allen, ehemals leitender Datenwissenschaftler bei Facebook. Joe Osborne, Sprecher von Facebook, teilte in einer Erklärung mit, dass das Unternehmen zum Zeitpunkt von Allens Bericht "diese Themen bereits untersucht" habe. "Seitdem haben wir Teams gebildet, neue Richtlinien entwickelt und mit Branchenkollegen zusammengearbeitet, um diese problematischen Netzwerke anzugehen." Man habe "aggressive Durchsetzungsmaßnahmen" gegen diese Art von in- und ausländischen "inauthentischen Gruppen" ergriffen. Man berichte regelmäßig über die Ergebnisse in vierteljährlichen Reports.

Doch so einfach ist das nicht. Bei der Überprüfung dieser Aussagen kurz vor der Veröffentlichung stellte MIT Technology Review fest, dass fünf der im Bericht erwähnten Troll-Farm-Seiten weiterhin aktiv sind. Auch die größte Trollfarm-Seite, die es im Oktober 2019 auf Afroamerikaner abgesehen hatte, ist weiterhin auf Facebook aktiv. Der Bericht stellte fest, dass die "problematischen Akteure" die selben demografischen Gruppen erreichen, die von der vom Kreml unterstützten "Internet Research Agency" (IRA) während der US-Wahlen 2016 ins Visier genommen wurden – nämlich Christen, schwarze Amerikaner und Mitglieder indigener Gruppen. Eine Untersuchung von BuzzFeed News [2] aus dem Jahr 2018 ergab, dass mindestens ein Mitglied der russischen IRA, das wegen mutmaßlicher Einmischung in die US-Wahlen 2016 angeklagt ist, auch Nordmazedonien – ein Land, das bekannt ist für seine Trollfarmen – besucht hatte, obwohl keine konkreten Beweise für eine Verbindung gefunden wurden. (Facebook sagte, seine Untersuchungen hätten auch keine Verbindung zwischen der IRA und den nordmazedonischen Trollfarmen ergeben.)

Chefs ignorierten Belege

"Das ist nicht normal. Das ist nicht gesund", schrieb Allen. "Wir haben Fake-Akteuren die Möglichkeit gegeben, riesige Followerzahlen für weitgehend unbekannte Zwecke anzuhäufen." Allen erstellte den Bericht als vierte und letzte Tranche seiner anderthalbjahre währenden Bemühungen, Troll-Farmen zu verstehen. Er verließ das Unternehmen noch im selben Monat, zum Teil aus Frustration darüber, dass die Unternehmensleitung seine Arbeit "effektiv ignoriert" hatte, so der ehemalige Facebook-Mitarbeiter. Allen lehnte eine Stellungnahme ab.

Der Bericht enthüllt den alarmierenden Zustand, in dem die Facebook-Führung die Plattform seit Jahren belässt. Die US-Ausgabe von MIT Technology Review stellt den vollständigen Bericht als PDF [3] mit geschwärzten Namen der Mitarbeiter zur Verfügung, da er im öffentlichen Interesse ist.

Die zentralen Enthüllungen umfassen:

- Im Oktober 2019 wurden rund 15.000 Facebook-Seiten mit einem mehrheitlich US-amerikanischen Publikum aus dem Kosovo und Nordmazedonien betrieben, die während der Wahl 2016 als "problematische Akteure" bekannt waren.

- Zusammengenommen erreichten diese Trollfarm-Seiten – die im Bericht zu Vergleichszwecken als eine einzige Page behandelt werden – monatlich 140 Millionen US-Nutzer und wöchentlich 360 Millionen Nutzer weltweit. Zum Vergleich: Die Seite der Supermarktkette Walmart erreichte mit 100 Millionen das zweitgrößte US-Publikum.

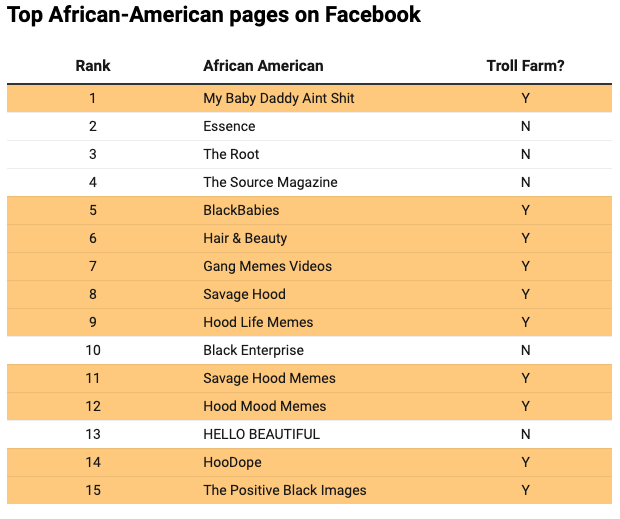

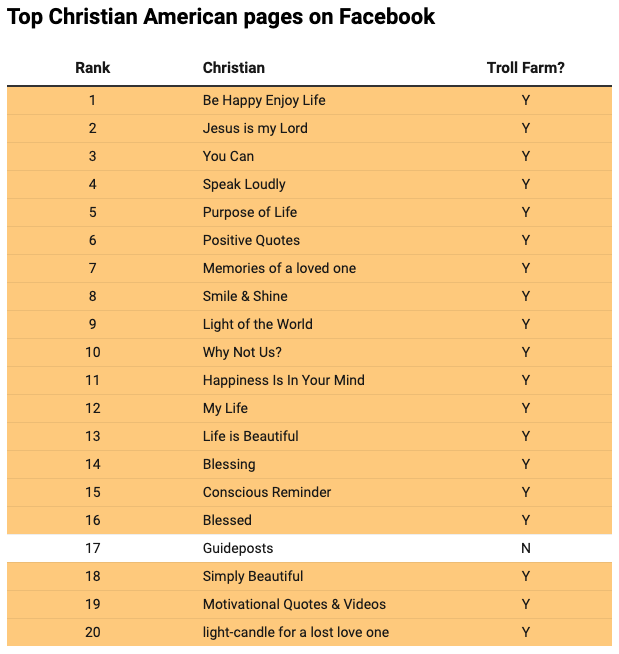

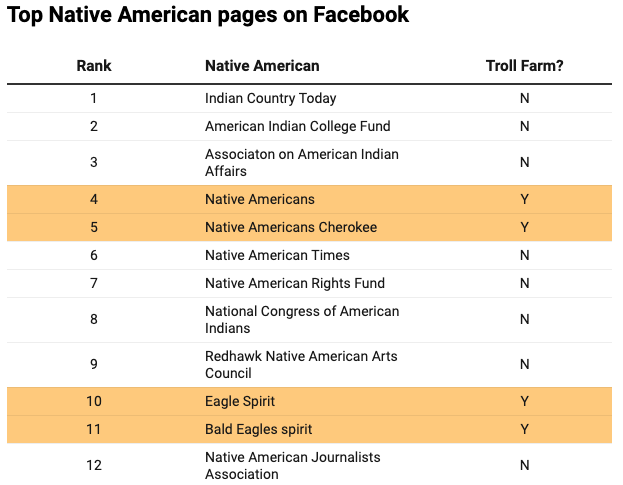

- Die Trollfarm-Seiten taten sich zusammen und bildeten unter anderem die größte christlich-amerikanische Seite auf Facebook, 20-mal größer als die nächstgrößere – mit einer monatlichen Reichweite von 75 Millionen US-Nutzern, von denen 95 Prozent noch nie einer der Seiten gefolgt waren. Außerdem stellten sie die größte afroamerikanische Seite auf Facebook, die dreimal so groß ist wie die nächstgrößere und monatlich 30 Millionen US-Nutzer erreicht, von denen 85 Prozent noch nie einer der Seiten gefolgt sind. Bei indigenen Nutzern auf Facebook werden monatlich 400.000 Nutzer erreicht (die zweitgrößte Seite ihrer Art, 90 Prozent folgten der Seite zuvor nicht). Bei Seiten für Frauen kamen die Trollfarmen auf die fünfgrößte mit monatlich 60 Millionen US-Nutzern. Hier folgten 90 Prozent der User der Page zuvor nicht.

- Trollfarmen betreffen in erster Linie die USA, aber auch das Vereinigte Königreich, Australien, Indien sowie mittel- und südamerikanische Länder.

- Facebook hat mehrere Studien durchgeführt, die bestätigen, dass Inhalte, die mit größerer Wahrscheinlichkeit von den Nutzern mit viel Engagement bedacht werden (Likes, Kommentare und Shares), eher von einer Art sind, die als problematisch bekannt ist. Dennoch hat das Unternehmen weiterhin die Inhalte in den Newsfeeds der Nutzer nach dem höchsten Engagement geordnet.

- Facebook verbietet es Seiten, Inhalte zu posten, die lediglich aus anderen Bereichen der Plattform kopiert wurden, setzt diese Richtlinie aber nicht gegen bekannte problematische Akteure durch. Dies macht es ausländischen Akteuren, die die Landessprache nicht sprechen, leicht, vollständig geklaute Inhalte zu posten und trotzdem ein großes Publikum zu erreichen. Zu einem bestimmten Zeitpunkt gingen bis zu 40 Prozent der Seitenaufrufe auf US-Seiten, die in erster Linie nicht originale Inhalte oder Material von geringer Originalität enthielten.

- Troll-Farmen haben auch ihren Weg in Facebooks Partnerschaftsprogramme "Instant Articles" und "Ad Breaks" gefunden, die eigentlich echten Nachrichtenorganisationen und Verlagen helfen sollen, ihre Artikel und Videos zu monetarisieren. Aufgrund fehlender grundlegender Qualitätskontrollen wurden bis zu 60 Prozent der Instant-Article-Lesevorgänge für Inhalte verwendet, die von anderen Seiten plagiiert worden waren. Dadurch war es für Trollfarmen ein Leichtes, sich unbemerkt in die Debatte einzumischen und dafür sogar Zahlungen von Facebook zu erhalten.

Facebook belohnt schlechte Inhalte

Der Bericht befasst sich speziell mit Trollfarmen aus dem Kosovo und Nordmazedonien, die von Leuten betrieben werden, die nicht unbedingt etwas von amerikanischer Politik verstehen. Aufgrund der Art und Weise, wie Facebooks "Belohnungssysteme" für den Newsfeed konzipiert sind, könnten sie dennoch einen erheblichen Einfluss auf den politischen Diskurs haben. In dem Bericht nennt Allen drei Gründe, warum diese Seiten ein so großes Publikum erreichen können. Erstens bestraft Facebook Seiten nicht für die Veröffentlichung komplett kopierter Inhalte. Wenn etwas schon einmal viral gegangen ist, wird es wahrscheinlich wieder viral gehen, wenn es ein zweites Mal gepostet wird.

Zweitens pusht Facebook für den Algorithmus "ansprechende" Inhalte auf Seiten auch an Personen, die diesen nicht folgen. Wenn die Freunde der Nutzer Beiträge auf einer dieser Seiten kommentieren oder teilen, sehen diese Nutzer den Inhalt auch in ihren Newsfeeds.

Drittens schiebt das Facebook-Rankingsystem Inhalte mit viel Engagement in den Newsfeeds der Nutzer weiter nach oben. In den meisten Fällen haben die Betreiber von Trollfarmen offenbar eher finanzielle als politische Motive; sie posten das, was die meiste Zustimmung findet, ohne Rücksicht auf den eigentlichen Inhalt. Da Falschinformationen, Clickbait und politisch spaltende Inhalte jedoch eher eine hohe Beteiligung erhalten (wie Facebooks eigene interne Analysen bestätigen), neigen Trollfarmen mit der Zeit dazu, mehr davon zu posten, heißt es in dem Bericht.

Infolgedessen wurden im Oktober 2019 alle 15 der Top-Seiten, die auf Amerikaner mit christlichen Interessen abzielen, 10 der Top-15-Facebook-Seiten, die auf schwarze Amerikaner abzielen, und vier der Top-12-Facebook-Seiten, die auf amerikanische Indigene abzielen, von Trollfarmen betrieben. Ein erschreckendes Ergebnis.

"Unsere Plattform hat die größte Stimme in der christlich geprägten amerikanischen Gemeinschaft an eine Handvoll böswilliger Parteien gegeben, die, basierend auf ihren Praktiken der Inhalteproduktion, nie in einer Kirche waren", schrieb Allen. "Und unsere Plattform hat die größte Stimme in der afroamerikanischen Gemeinschaft einer Handvoll böswilliger Akteure gegeben, die, basierend auf ihren Praktiken der Inhalteproduktion, noch nie eine Interaktion mit einem Afroamerikaner hatten."

(bsc [5])

URL dieses Artikels:

https://www.heise.de/-6194971

Links in diesem Artikel:

[1] https://de.wikipedia.org/wiki/Whac-A-Mole

[2] https://www.buzzfeednews.com/article/craigsilverman/american-conservatives-fake-news-macedonia-paris-wade-libert

[3] https://s3.documentcloud.org/documents/21063547/oct-2019-facebook-troll-farms-report.pdf

[4] https://www.heise.de/tr/

[5] mailto:bsc@heise.de

Copyright © 2021 Heise Medien