Klare Sicht auf die alltägliche Dystopie

Bitte lächeln, Ihr Foto könnte herumgereicht werden. Bild: Endstation Jetzt, CC BY 2.0

Die Bilddatenbank von Clearview AI, das Ende der Anonymität und die Überwachungsmaschinerie im 21. Jahrhundert. Wie ein Start-up unsere Fotos missbraucht

Anfang 2020 kam die erste aufsehenerregende Enthüllung: Die US-Firma Clearview hatte über Jahre hinweg im Internet Milliarden Fotos für eine Datenbank für biometrische Zwecke gesammelt und diese dann verkauft. Veräußert wurden die Daten zu Identifikationszwecken, zunächst offiziell "nur" an hunderte Strafverfolger in 27 Ländern, darunter 2.400 Polizeiwachen. Später stellte sich heraus: auch an private Kunden.

Alle Bilder stammen von Webseiten und sozialen Netzwerken. Sie wurden grundsätzlich ohne Wissen und Einwilligung der Eigentümer sowie abgebildeten Personen abgegriffen. Sie werden automatisch ausgewertet und können mit frischen Bildern von Ermittlern abgeglichen werden, Verhaltens- und Aufenthaltsprofile von Verdächtigen sind gratis dabei.

Geburtsfehler der Biometrie

Biometrie, sagen Sicherheitsexperten, hat einen großen Nachteil: Egal welches Merkmal man nimmt, es existiert nur in einer endlichen, kleinen Anzahl. Ist ein Fingerabdruck einmal archiviert, bleiben nur noch neun nicht erkannte Fingerabdrücke, jeder Mensch hat nur zwei Augen für den Iris-Scan und vom Gesicht, der Handschrift oder dem Tippverhalten gibt es nur ein Exemplar.

Der Uralt-Standard Passwort dagegen bietet unendliche Funktionen, begrenzt nur durch das Gedächtnis des Anwenders. Sogar ein aufgeschriebenes und sicher verwahrtes Passwort ist bisweilen sicherer als ein Fingerabdruck, den man ja überall hinterlässt, auf Gläsern, Türen, in Bussen und Bahnen.

Aber dass ein Foto-Upload von einer Party oder aus dem Urlaub von Ermittlern automatisiert zu biometrischen Identifikationszwecken verwendet würde, konnte oder wollte sich bis letztes Jahr niemand vorstellen.

Nun ist Biometrie nichts anderes als ein sehr komplexes, einem Passwort ähnliches Verfahren. Gerade bei der Gesichtserkennung ziehen Firmen dazu viele Faktoren heran, um ein Profil im besten Wortsinn zu erstellen. Anders als Passworte (oder Benutzernamen) lassen sich manche biometrischen Merkmale auch perfekt ausnutzen, um Menschen zu überwachen. Das gelingt je besser, desto offensichtlicher sie sind, am besten eben mit Gesichtern, weil diese sehr individuell und auch bequem aus der Ferne erkennbar sind.

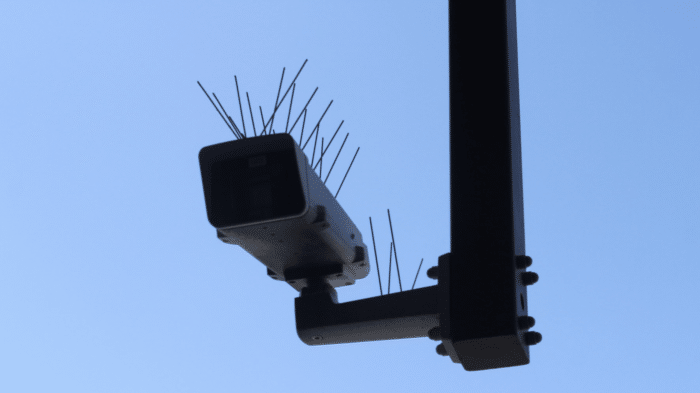

Doch niemand bedachte wohl bisher beim Bild-Upload, dass er durch das geteilte Foto das Risiko einer Überwachung eingeht. Derlei vermutete man eher in Ländern, wo kompromisslose Regierungen Künstliche Intelligenz und Kameras nutzen, so etwa in China. Fast jeder Bürger der Volksrepublik wird nahezu ständig von Kameras überwacht, automatisch erkannt und sanktioniert, wenn er Gesetzesverstöße begeht.

Chinesische Zustände

All das scheint undenkbar in westlichen Demokratien. Erst recht nicht in Europa, wo Privatsphäre und Datenschutz grundlegende Werte darstellen und eine DSGVO erfolgreich Google, Facebook oder Microsoft in die Schranken gewiesen hat. Das Recht am eigenen Bild verhindert so Datenbanken mit Profilen, die der automatisierten Gesichtserkennung dienen, auch wenn wir uns dazu verleiten lassen, Massen von Selfies zu posten.

Eine erste Beschwerde, eingereicht 2020 von Matthias Marx bei der Hamburger Datenschutzbehörde, brachte erst nach elf Monaten und Stellungnahmen durch noyb.eu klare Ergebnisse. Noyb.eu ("None of Your Business") ist die Nichtregierungsorganisation des Österreichers Max Schrems, der durch seine Klagen gegen Facebook und das Privacy-Shield-Urteil bekannt geworden ist.

Im Februar entschied der Hamburger Beauftragte für Datenschutz und Informationsfreiheit, dass Marx das Recht auf Löschung des so generierten Hash-Wertes zustehe. Ein "Minimalurteil" nennt das noyb.eu und zeigt sich enttäuscht, dass die Datenschützer nicht auch das Sammeln der Daten verboten haben - ganz zu schweigen von der Anforderung, alle Fotos von Marx zu löschen.

Die Existenz einer solchen Überwachungsmaschine ist erschreckend. Fast ein Jahr nach meiner ursprünglichen Beschwerde muss Clearview AI nicht einmal die Fotos löschen, die mich zeigen. Schlimmer noch, jede:r einzelne Betroffene muss nun selbst Beschwerde einlegen. Das zeigt, dass unsere Daten noch nicht ausreichend geschützt werden und Handlungsbedarf gegen biometrische Überwachung besteht.

Trotz DSGVO kaum Erfolgsaussichten für Verbraucher

Wer Clearview also gemäß der DSGVO verbieten will, Bilder von sich zu sammeln, muss Einspruch einlegen und hoffen. Der Vorwurf gegen die Firma, neben den Bildern selbst auch sämtliche Metadaten aus diesen auszuwerten und dafür auch nicht vor Verschleierung zurückzuschrecken, wiegt schwer. Nur scheibchenweise kamen die Details ans Licht, nachdem die New York Times im Januar 2020 die Geschäftspraktiken offengelegt hatte. Vor wenigen Tagen hat noyb.eu zusammen mit anderen Organisationen Beschwerde eingelegt bei Datenschutzbehörden in Frankreich, Österreich, Italien, Griechenland und Großbritannien.

In Italien mussten Datenschützer den Polizeikräften bereits untersagen, Daten aus der Clearview-Datenbank für Echtzeitgesichtserkennung zu nutzen.

Alan Dahi, Datenschutzjurist bei noyb.eu erklärt dazu:

Nur weil etwas online ist, ist es nicht automatisch Freiwild, das sich andere auf beliebige Weise aneignen können - das ist weder moralisch noch rechtlich zulässig. Die Datenschutzbehörden müssen aktiv werden und Clearview und ähnliche Organisationen daran hindern, die persönlichen Daten von EU-Bürgern abzugreifen." Die nächsten 3 Monate werden zeigen, ob sich diese Rechte auch durchsetzen lassen - so lange haben die Regulierungsbehörden jetzt Zeit, um eine erste Antwort zu geben.

Verfahren auch in den USA

Auch in den USA hat Clearview AI einige Verfahren am Hals, beispielsweise in Kalifornien, wo die Aktivistengruppen Mijente und NorcalResist klagen. In dem Westküstenstaat sind Polizeibehörden selten zimperlich, wenn es um Überwachung geht. Nach 2015 wurden nach langem Streit Details des Projekts "Stingray" bekannt, eine Überwachungsmaschine, die dem Science-Fiction-Film "Blue Thunder" nahekommt.

Mikrofone überwachen Bushaltestellen oder alarmieren die Polizei, sollte ein Schuss fallen. Es gehört zum Alltag in Kalifornien, dass der, der sich etwa nachts verbotenerweise auf einem Kinderspielplatz aufhält, schon mal per Hubschrauber und Suchscheinwerfer über seine Rechte aufgeklärt wird. Dank der Daten von Clearview können ihn die Ermittler dann auch namentlich ansprechen, wenn beispielsweise der serienmäßig an Bord verbaute IMSI-Catcher versagt. Auch die New Yorker Polizei musste nach Jahren des Schweigens und Leugnens 2021 einräumen, Clearviews Daten zu nutzen.

Anders als in der EU bezieht sich die kalifornische Klage darauf, dass die "Massenüberwachungstechnologie von Clearview AI die Persönlichkeitsrechte von Menschen in Kalifornien im Allgemeinen verletze und Immigranten und farbige Gemeinschaften besonders stark schädige", berichtet beispielsweise die Seite mixed.de.

Clearview antwortet mit Verweis auf den ersten Zusatz zur US-Verfassung, also Redefreiheit, Religionsfreiheit, Pressefreiheit, Versammlungsfreiheit. Die Argumentation dürfte in der EU nicht Erfolg haben, egal ob die Nutzungsbedingungen von Facebook, Twitter oder anderen Diensten verletzt wurden oder nicht. Vielleicht aber erweist sich der Fall als ein weiterer Prüfstein für die DSGVO und die Fähigkeit der EU, europäische Werte und Gesetze auch in anderen Kulturräumen durchzusetzen.

Der Gründer aus der Alt-Right-Szene

Dass dies wichtig wäre, zeigen auch die Hintergründe der Firma Clearview AI. Da wäre zunächst der Firmengründer Hoan Ton-That, ein australisch-vietnamesischer Unternehmer, der seine ersten Gehversuche in der IT-Gründerszene Kaliforniens mit Phishing- und Social-Media-Applikationen machte. Später heuerte er beim Netzwerk Angel.list an. Auf dem Weg zu einer neuen Karriere als Model lernte er Co-Gründer und Politiker Richard Schwarz kennen, der zu dessen Amtszeit mit New Yorks Bürgermeister Rudy Giuliani zusammenarbeitete und den (erfolglosen) Porno-Filter Clicksafe.com mit ins Leben gerufen hatte.

Unter den frühen Investoren in Clearview AI, gegründet 2017, finden sich zahlreiche bekannte Gesichter der US-amerikanischen Rechten, beispielsweise der Gründer von Paypal, Facebook und des Herstellers von Überwachungssoftware Palantir, Peter Thiel. Auch wenn Clearview keine Details nennt, vermuten Analysten, dass der Großteil der 8,5 Millionen US-Dollar, die Clearview Ende 2020 erhielt, also nach den geschilderten Enthüllungen, von Thiel stammen.

Noch mehr Klagen in den USA

Nach der Veröffentlichung durch die New York Times sah sich Clearview AI einer Welle von Löschaufforderungen konfrontiert. Sowohl Twitter, Youtube, Facebook als auch Google: Alle sandten die Aufforderungen, mit der unerlaubten Übernahme von Abbildungen unverzüglich aufzuhören.

Für Aufsehen sorgte auch die Anfrage der Polizei aus Alabama, die Daten für die Aufklärung des Sturms aufs Kapitol Anfang Januar verwenden wollten. Das FBI verweigerte jede Auskunft. Aber an skurrilen Ideen bestand bei Clearview AI kein Mangel: Schon 2020 erklärte Ton-That im Fernsehen, wie die Gesichtserkennung für das Corona-Contact-Tracing genutzt werden könne.

Nach einem massiven Datenleck Anfang 2020 erklärte ein Anwalt der Firma dem Portal Daily Beast, Datenpannen seien nun einmal "Teil des Lebens im 21. Jahrhundert". Die Erklärung, man werde nicht mehr an private Kunden verkaufen, scheint ebenso wenig belastbar, wie es für Einzelpersonen einen echten Ausweg aus der Datenbank gibt.

Markus Feilner arbeitet seit 1994 mit Linux, war stellvertretender Chefredakteur des Linux-Magazins und der iX, Teamleiter Dokumentation beim Linux-Hersteller SUSE und hat sich mit seiner Firma Feilner IT auf Dokumentation und die OSI Layer 8, 9 und 10 spezialisiert.