Duell der KIs

(Bild: Ian Goodfellow)

Ein neues Verfahren versetzt Computer in die Lage, aus dem Nichts realistisch wirkende Fotos oder Videos zu erzeugen. Ian Goodfellow hat es erfunden – und kämpft seitdem gegen die dunkle Seite seiner Entdeckung.

Die Idee entstand am Kneipentisch: Eigentlich wollte Ian Goodfellow 2014 mit einem Doktoranden-Kollegen dessen Abschluss feiern. Doch am Tisch der jungen Forscher bei Les 3 Brasseurs, einem beliebten Treffpunkt in Montreal, wurde nicht nur getrunken, sondern auch über fachliche Probleme diskutiert. Ein paar Freunde baten Goodfellow um Hilfe bei einem schwierigen Projekt, an dem sie gerade arbeiteten: einen Computer dazu zu bringen, eigenständig und ohne Vorlagen Fotos zu generieren.

Bilder ohne Vorlagen generieren

Im Prinzip ließ sich dieses Problem durch ein neuronales Netz lösen. Doch die Ergebnisse der bis dahin gebräuchlichen "generativen Modelle" waren häufig nicht gut: Die Bilder eines Gesichts waren tendenziell unscharf oder wiesen grobe Fehler wie etwa fehlende Ohren auf. Beim Bier kam ihm jedoch eine Idee. Wie wäre es, wenn man das Problem durch zwei neuronale Netze lösen würde, die gewissermaßen gegeneinander antreten? Seine Freunde waren skeptisch.

Als Goodfellow nach Hause kam, schlief seine Freundin längst. Doch er beschloss, seine Idee gleich zu testen, setzte sich an den Computer und programmierte bis in die frühen Morgenstunden. Die Software funktionierte sofort.

Generative Adversarial Network

Was Goodfellow in jener Nacht erfand, wird heute als GAN bezeichnet, kurz für "Generative Adversarial Network". Die Technik hat für enorme Aufregung auf dem Gebiet des Maschinenlernens gesorgt, denn die Fähigkeit, uns viele unterschiedliche Szenarien vorzustellen, ist ein wichtiger Teil von dem, was uns zu Menschen macht. Und wenn zukünftige Technikhistoriker in die Vergangenheit blicken, dürften sie GANs als bedeutenden Schritt bei der Entwicklung von Maschinen mit menschenähnlichem Bewusstsein betrachten. Yann LeCun, der oberste KI-Wissenschaftler von Facebook, bezeichnet GANs jedenfalls als "die coolste Idee bei Deep Learning in den letzten 20 Jahren". Für Andrew Ng, ein weiterer KI-Visionär und ehemaliger Chefwissenschaftler bei Baidu in China, sind GANs "ein bedeutender und grundlegender Fortschritt", der eine wachsende globale Gemeinschaft von Forschern inspiriert.

Die Magie von GANs liegt in der Art, wie die zwei konkurrierenden neuronalen Netze gegeneinander arbeiten. Sie bilden gewissermaßen den Wettlauf zwischen einem Kunstfälscher und einem Kunstdetektiv ab: Beide versuchen in mehreren Runden, schlauer als der jeweils andere zu sein. Beide Netze werden mit derselben Datensammlung trainiert. Das erste, genannt Generator, hat die Aufgabe, künstliche Outputs wie Fotos oder Handschriften zu erzeugen, die so realistisch sind wie möglich. Das zweite, der Diskriminator, vergleicht das Ergebnis mit echten Bildern aus der Trainingssammlung und versucht, Originale und Fälschungen zu unterscheiden. Auf der Basis dieser Ergebnisse passt der Generator seine Parameter für das Erzeugen neuer Bilder an. Und so geht es weiter, bis der Diskriminator nicht mehr erkennen kann, was echt ist und was gefälscht.

Wettlauf zwischen den KIs

Noch ist die "Vorstellungskraft" von GANs begrenzt. So generiert ein GAN, nachdem es mit einer Reihe von Hundefotos trainiert wurde, zwar ein überzeugendes Bild eines Hundes, der zum Beispiel ein anderes Fellmuster hat. Ein vollkommen neues Tier aber kann es sich nicht ausdenken. Zudem hat die Qualität des Trainingsmaterials großen Einfluss auf die Ergebnisse. Sehr deutlich zeigte sich das bei einem GAN, das Bilder von Katzen mit willkürlich eingestreuten Buchstaben produzierte: Weil in den Trainingsdaten Katzen-Memes aus dem Internet enthalten waren, hatte sich die Maschine selbst beigebracht, dass Worte ein Bestandteil von dem sein müssten, was sie als Katze ansah.

Zudem sind GANs "launisch", sagt Pedro Domingos von der University of Washington, der seit Langem zu maschinellem Lernen forscht. Wenn sich der Diskriminator zu leicht in die Irre führen lasse, werde der Output des Generators nicht realistisch. Und die Kalibrierung der zwei rivalisierenden Netze könne schwierig sein, was erklärt, dass GANs manchmal bizarre Ergebnisse wie Tiere mit zwei Köpfen ausspucken. Doch diese Herausforderungen können Forscher nicht abschrecken. Seit Goodfellow und einige Kollegen im Jahr 2014 die erste Studie über seine Entdeckung publizierten, wurden Hunderte von Fachaufsätzen zum Thema GAN geschrieben. Goodfellow ist inzwischen Wissenschaftler im Team von Google Brain am Hauptsitz des Unternehmens in Mountain View in Kalifornien. Als ich ihn vor Kurzem dort traf, schien er immer noch überrascht von seinem Superstar-Status zu sein, den er als "etwas surreal" bezeichnete. Ein Fan der Technologie hat sogar eine Website namens "GAN Zoo" erstellt, auf der er dokumentiert, welche unterschiedlichen Versionen davon entwickelt werden.

Ein ganzer Zoo von GANs

Die offensichtlichsten unmittelbaren Anwendungen liegen in Bereichen mit viel Bildmaterial, etwa Videospiele oder Mode. Wie zum Beispiel könnte es aussehen, wenn eine Spielfigur durch den Regen läuft? Mit Blick auf die Zukunft aber hofft Goodfellow darauf, dass GANs bedeutendere Fortschritte ermöglichen werden. "Es gibt viele Bereiche von Wissenschaft und Technik, in denen etwas optimiert werden muss", sagt er und nennt als Beispiel Medikamente oder Batterien mit möglichst hoher Effizienz. "Das wird die nächste große Welle sein."

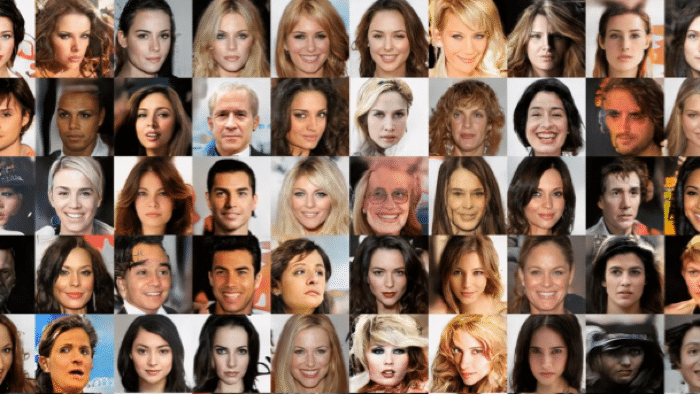

(Bild: NVIDIA)

In der Hochenergiephysik nutzen Wissenschaftler leistungsfähige Computer, um die wahrscheinlichen Interaktionen von Hunderten subatomaren Partikeln in Anlagen wie dem Large Hadron Collider am Cern in der Schweiz zu simulieren. Forscher an der Yale University und am Lawrence Berkeley National Laboratory haben ein GAN entwickelt, das aus diesen Simulationsdaten die Bilder erzeugt, die die Wissenschaftler nach einem solchen Ereignis auf den Bildschirmen ihrer Detektoren sehen werden.

Ein weiteres Gebiet mit viel Potenzial ist die medizinische Forschung. Aufgrund von Datenschutzregeln können Forscher hier manchmal nicht genügend echte Patientendaten bekommen, um zum Beispiel zu analysieren, warum ein bestimmtes Medikament nicht gewirkt hat. GANs könnten zur Lösung dieses Problems beitragen, indem sie falsche Krankenakten generieren, die so gut sind wie echte, sagt Casey Greene von der University of Pennsylvania. Solche Daten könnten auch weitergegeben werden und dazu beitragen, die Forschung voranzubringen, während die echten Daten gut geschützt bleiben.

Potenzial in der Physik und Pharmaforschung

Goodfellow selbst bringt seit seiner Entdeckung allerdings einen großen Teil seiner Arbeitszeit mit der dunklen Seite der Technologie zu: Er kämpft gegen diejenigen, die sie für bösartige Zwecke nutzen wollen. Viel berichtet wurde im vergangenen Jahr über ein Projekt von Forschern des Chipherstellers Nvidia: Sie trainierten ein GAN darauf, Bilder von falschen Prominenten zu generieren. Als Vorlage nutzen sie Aufnahmen echter Berühmtheiten. Anders als andere Ansätze für Maschinenlernen, die Zehntausende von Trainingsbildern brauchen, können GANs schon mit ein paar Hundert gut lernen.

Eine Maschine, die dafür entwickelt wurde, realistische Fälschungen zu erstellen, ist die perfekte Waffe für die Verbreitung von Fake News, mit denen sich von Aktienkursen bis zu Wahlen fast alles manipulieren lässt. KI-Werkzeuge werden bereits verwendet, um Bilder der Gesichter anderer Personen auf die Körper von Pornodarstellern zu montieren oder Politikern Worte in den Mund zu legen. GANs haben dieses Problem nicht neu geschaffen, aber sie werden es gravierender machen.

Missbrauch für Deep Fakes und Fake News

Ein ähnliches Katz-und-Maus-Spiel wird es bei der Cybersicherheit geben. Forscher warnen bereits vor der Gefahr von "Black Box"-Angriffen, bei denen mithilfe von GANs die Maschinenlernmodelle ausgeforscht werden, mit denen eine ganze Reihe von Sicherheitsprogrammen Malware identifiziert. Wenn er herausgefunden hat, wie der Abwehr-Algorithmus eines Ziels funktioniert, kann der Angreifer ihn umgehen und bösartigen Code einschmuggeln. Derselbe Ansatz könnte genutzt werden, um Spam-Filter und andere Abwehrmaßnahmen zu überwinden.

Nun wollen Forscher diese Probleme mit neuer Technologie wieder in den Griff bekommen. Goodfellow selbst leitet bei Google ein Team, das daran arbeitet, Maschinenlernen sicherer zu machen. Die KI-Community müsse die Lektionen aus früheren Innovationswellen lernen, bei denen Sicherheit und Datenschutz als Nebensache behandelt wurden, erklärt er. Bis die Risiken erkannt wurden, hatte die böse Seite dadurch schon einen deutlichen Vorsprung. "Den Anfang haben wir eindeutig schon hinter uns", sagt Goodfellow, "aber hoffentlich können wir erhebliche Fortschritte bei der Sicherheit machen, bevor wir zu weit vorangekommen sind."

(Bild: Alec Redford / Ian Goodfellow)

Fälscher sind einen Schritt voraus

Ob Ähnliches jedoch auch bei Fälschungen von Bildern oder Videos gelingt, ist fraglich – auch wenn es Forscher derzeit versuchen. Hany Farid etwa, der sich am Dartmouth College mit digitaler Forensik beschäftigt, arbeitet an besseren Methoden zur Erkennung von Fake-Videos, etwa anhand von leichten Veränderungen der Gesichtsfarbe beim Ein- und Ausatmen; bislang sind GANs relativ schlecht darin, das exakt nachzuahmen.

Doch er warnt, dass sich die Netze wieder anpassen werden. "Wir sind in einer fundamental schwachen Position", sagt der Forscher. Das weiß auch Goodfellow. Er ist daher nicht der Meinung, dass es eine rein technische Lösung gegen das Problem der Fälschungen geben wird. Eher werden wir gesellschaftliche Lösungen entwickeln müssen. Man könne Kinder mit Vortrags- und Debattier-Unterricht in kritischem Denken schulen. "Bei Reden und Diskussionen tritt man gegen andere Schüler an", erklärt er, "und man denkt darüber nach, wie man irreführende Behauptungen aufstellt oder korrekte Behauptungen, die große Überzeugungskraft haben." Damit dürfte Goodfellow richtig liegen. Trotzdem werden viele Menschen seine Schlussfolgerung nicht gern hören.

(bsc [1])

URL dieses Artikels:

https://www.heise.de/-4133903

Links in diesem Artikel:

[1] mailto:bsc@heise.de

Copyright © 2018 Heise Medien