Bilderkennung: Unschlagbar menschlich

Optische Täuschungen sind faszinierend und ermöglichen interessante Einblicke in das visuelle System von Menschen. Maschinen aber sind damit bislang weitgehend überfordert.

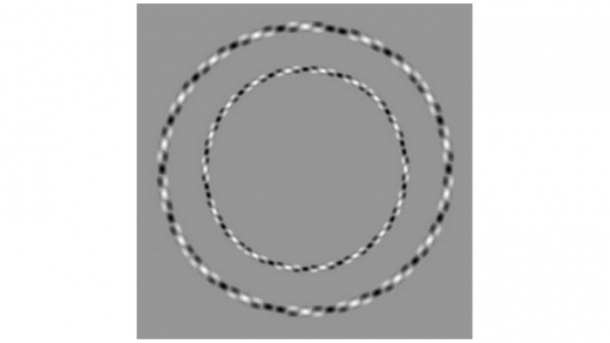

Optische Täuschungen: Sind das konzentrische Kreise?

- TR Online

Das visuelle System von Menschen ist eine außergewöhnliche Fähigkeit. Es entstand in bestimmten Umgebungen im Verlauf mehrerer Millionen Jahre, kommt aber heute trotzdem mit Aufgaben zurecht, mit denen frühere visuelle Systeme nichts zu tun hatten. Gute Beispiele dafür sind Lesen oder das Identifizieren von künstlichen Objekten wie Autos, Flugzeugen, Straßenschildern etc.

Gleichzeitig aber hat unser visuelles System eine bekannte Reihe von Schwächen, die sich in optischen Täuschungen äußern. Tatsächlich haben Forscher schon viele Möglichkeiten identifiziert, wie Menschen dazu gebracht werden können, Farben, Größen, Verhältnisse oder Bewegungen falsch einzuschätzen.

Manchmal sind diese Illusionen selbst von Interesse, weil sie Einblicke in den Charakter des visuellen Systems und von Wahrnehmung ermöglichen. Also wäre es enorm hilfreich, neue Täuschungen zu finden, die uns mehr über die Grenzen des Sehvermögens verraten.

Hilft Deep Learning?

An diesem Punkt könnte Deep Learning ins Spiel kommen. In den vergangenen Jahren haben Maschinen gelernt, Objekte und Gesichter auf Bildern zu erkennen und dann eigenständig ähnliche Bilder zu erzeugen. Also wäre denkbar, dass ein System für maschinelles Sehen auch lernen kann, optische Täuschungen zu erkennen und dann eigene zu erstellen.

Robert Williams und Roman Yamplowskiy an der University of Lousville haben sich jetzt mit diesem Thema beschäftigt – und dabei festgestellt, dass die Überlegung nicht leicht in die Praxis umzusetzen ist. Systeme für maschinelles Lernen sind nicht in der Lage, eigene optische Täuschungen zu erzeugen, noch jedenfalls nicht. Und warum?

Dazu muss man zunächst wissen, dass die aktuellen Fortschritte bei Maschinenlernen auf zwei Faktoren beruhen. Der erste ist die Verfügbarkeit von leistungsfähigen neuronalen Netzen und von ein paar Programmier-Tricks, die diesen Netzen eine gute Lernfähigkeit verleihen.

Riesige Datenbanken

Zweitens wurde riesige annotierte Datenbanken aufgebaut, anhand derer Maschinen lernen können. Für das Trainieren von Gesichtserkennung zum Beispiel braucht man zehntausende Bilder mit Gesichtern, die klar als solche gekennzeichnet sind. Mit diesen Informationen kann ein neuronales Netz dann lernen, für Gesichter charakteristische Merkmale zu erkennen – zwei Augen, eine Nase und ein Mund zum Beispiel. Wenn man zwei neuronale Netze nimmt, können diese sich sogar gegenseitig beibringen, realistische Gesichtsbilder zu erzeugen, die komplett synthetisch sind; dieser Ansatz wird als „generative adversarial network“ (GAN) bezeichnet.

Williams und Yampolskiy wollten ein neuronales Netz darauf trainieren, auf dieselbe Weise optische Täuschungen zu erkennen. Die nötige Rechenleistung ist problemlos verfügbar, nicht aber die Daten dafür. Also mussten die Forscher zunächst einmal eine Datenbank von optischen Täuschungen für das Maschinen-Training erstellen.

Und genau das erwies sich als schwierig. „Die Zahl der Bilder von statischen optischen Täuschungen beläuft sich auf wenige tausend, und wirklich unterschiedliche Täuschungen gibt es noch viel seltener, vielleicht nur ein paar Dutzend“, schreiben die Forscher.

(Bild: Pixabay)

Ergebnisse enttäuschend

Für derzeitige Maschinenlern-Systeme reicht das nicht aus. „Die Entwicklung eines Modells, das mit einer so kleinen und begrenzten Datensammlung lernen kann, würde einen enormen Fortschritt bei generativen Modellen und beim Wissen über das visuelle System von Menschen erfordern“, erklären Williams und Yampolskiy.

Die beiden Forscher stellten eine Datenbank mit gut 6000 Bildern von optischen Täuschungen zusammen und trainierten dann ein neuronales Netz auf deren Erkennung. Anschließend entwickelten sie ein GAN, das eigene Illusionen erzeugen sollte.

Die Ergebnisse waren enttäuschend. „Nach sieben Stunden Training auf einer Nvidia Tesla K80 entstand nichts, das einen Wert gehabt hätte“, schreiben die Forscher. Ihre Datenbank haben sie zur allgemeinen Nutzung geöffnet.

Menschen spielen entscheidende Rolle

Trotzdem ist die Arbeit interessant. „Die einzigen optischen Täuschungen, die Menschen bekannt sind, sind durch die Evolution (zum Beispiel Augenmuster auf den Flügeln von Schmetterlingen) oder durch menschliche Künstler entstanden“, erklären Williams und Yampolskiy. In beiden Fällen spielten Menschen eine entscheidende Rolle, weil sie wertvolle Rückmeldungen lieferten – sie können die Täuschung ja tatsächlich sehen. Bei Systemen für maschinelles Sehen ist das anders. „Dass ein GAN lernen könnte, das menschliche Sehvermögen auszutricksen, ohne die Prinzipien hinter den Täuschungen zu verstehen, ist unwahrscheinlich“, schreiben die Forscher.

Das Problem ist, dass es zwischen maschinellem und menschlichem Sehen erhebliche Unterschiede gibt. Mehrere Forscher entwickeln bereits neuronale Netze, die dem menschlichen visuellen System immer enger nachempfunden sind. Möglicherweise werden diese besser in der Lage sein, optische Täuschungen zu erkennen.

Williams und Yampolskiy aber sind nicht sehr optimistisch. „Wie es scheint, reicht eine Datenbank mit Bildern von optischen Täuschungen nicht aus, um neue Täuschungen zu erzeugen“ halten sie fest. Einstweilen also sind optische Täuschungen eine Bastion der menschlichen Erfahrung, die Maschinen noch nicht einnehmen können.

()