Google zahlt 5 US-Dollar für Gesichtsscan, um Pixel 4 zu trainieren

Google bezahlte Passanten, um ihre Gesichter zu scannen. Das soll die Gesichtserkennung des Pixel 4 verbessern – die Algorithmen sind sonst nicht ausgewogen.

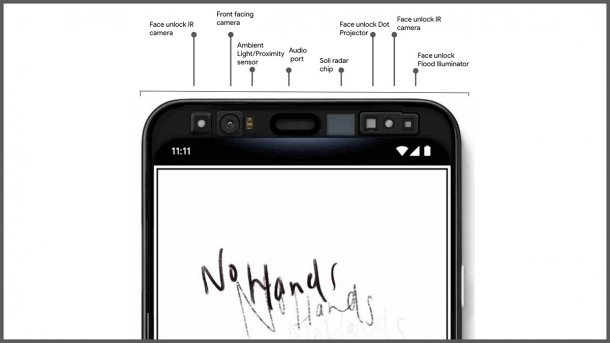

Schau mir in die Sensoren, Kleines: Das Pixel 4 lässt sich mit dem Gesicht entsperren.

(Bild: Google)

Was ist ein Gesicht wert? Fünf US-Dollar, meint Google – das zumindest ist der Preis, den Google-Mitarbeiter Passanten anboten, wenn sie dafür ihr Gesicht scannen ließen. Das Geld gab es nicht bar auf die Hand, sondern in Form eines Geschenkgutscheins. Mit den bezahlten Scans trainierte Google die Gesichtserkennung seines kommenden Pixel-4-Smartphones. Sie ist vergleichbar mit "Face ID" von Apple, soll laut Google aber flexibler arbeiten.

Google bestätigte gegenüber The Verge seine "Feldforschung", die in US-Städten durchgeführt wurde. Die Scans sollen sicherzustellen, dass das Pixel 4 mit vielen unterschiedlichen Gesichtern problemlos zurechtkommt, erklärte ein Unternehmenssprecher. Biometrische Erkennungssysteme hatten in der Vergangenheit immer wieder Schwierigkeiten, Gesichter richtig zu erkennen. Der Grund: Die Algorithmen sind voreingenommen, was Hautfarbe, Geschlecht und Rasse angeht. Amazons Gesichtserkennung Rekognition etwa hat Probleme, weibliche und dunkelhäutige Gesichter zuverlässig zu identifizieren – das zeigt eine neue Untersuchung des MIT Media Lab. Sie baut auf einer vorherigen Studie auf, die veranschaulichte, dass Algorithmen am besten weiße, männliche Gesichter erkennen. Bei dunkelhäutigen Frauen versagte die Gesichtserkennung hingegen.

KI ignoriert Hautfarbe

Schuld daran ist eine einseitige Lernbasis. Das bewies auch die Web-App "AI Portraits Ars": Sie verwandelte Selfies in Gemälde, ignorierte dabei aber die Hautfarbe der abgelichteten Personen. Aus dunkler Haut wurde in den KI-Gemälden helle, zudem verschwanden asiatische Gesichtszüge. Die KI wurde zuvor mit 45.000 historischen Porträts aus verschiedenen Epochen trainiert – und die zeigen vornehmlich weiße Gesichter. Auch das Lächeln verschwand deshalb aus vielen Selfies, denn damals gab es auf Porträts nichts zu lachen. (Nach einen Nutzeransturm ist die Web-App nicht mehr erreichbar.)

Probleme mit einer voreingenommenen Gesichtserkennung will Google bei seinem neuen Pixel-Smartphone unbedingt vermeiden. Schließlich gibt es mit "Face ID" von Apple starke Konkurrenz. Ziel sei es, die Gesichtserkennung "mit robuster Sicherheit und Leistung zu entwickeln", erklärte Google. "Dabei haben wir auch immer die Inklusion im Hinterkopf, damit so viele Menschen wie möglich davon profitieren können." Google muss seinen Algorithmus deshalb mit möglichst vielen und vielfältigen Gesichtern trainieren. Apple stellte 2017 für "Face ID" eine "repräsentative Gruppe" an Menschen zusammen, die unterschiedliche Geschlechter, Ethnien und Altersgruppen berücksichtigte.

Pixel 4 speichert Gesichtsdaten nur lokal

Bei den experimentellen Scans erfasste Google Infrarot-, Farb- sowie Tiefendaten von jedem Gesicht. Zusätzlich werden Zeit, Lichtkonditionen und weitere Zusatzinformationen gespeichert. Ursprünglich hatte Google auch Standortdaten erfasst; diese würden aber nicht benötigt und deshalb gelöscht, versicherte Google. Jedem Teilnehmer wurde eine Nummer zugeordnet, separat davon speichert Google die Mailadressen, damit die Gesichtsdaten auf Nachfrage gelöscht werden können. Davon abgesehen werden die Informationen 18 Monate lang gespeichert.

Das kommende Pixel 4 verwendet für die Gesichtserkennung ein ganzes Sensoren-Array, bestehend aus Kamera, Soli-Chip (Radar), Helligkeits- und Distanzsensor sowie zwei Infrarot-Kameras. The Verge schreibt, dass Google für die Erkennung eine komplette Tiefenkarte des Gesichts erstellt. Die Daten speichert das Pixel-Gerät lokal im Sicherheitschip "Titan M". Auf Google-Server gelangen die persönlichen Gesichtsdaten nicht: Sie "verlassen niemals das Telefon", erklärt Google. Das Pixel 4 soll noch dieses Jahr auf den Markt kommen. Seine Besonderheit ist der Soli-Chip, mit dem das Smartphone kleine Fingergesten erkennen soll. (dbe)