Entwickeln für die Apple Vision Pro: So funktioniert das visionOS SDK

Die Vision Pro lässt hierzulande auf sich warten, Entwickler müssen sie noch aus den USA importieren. So nutzt man den visionOS-Simulator und erstellt Apps.

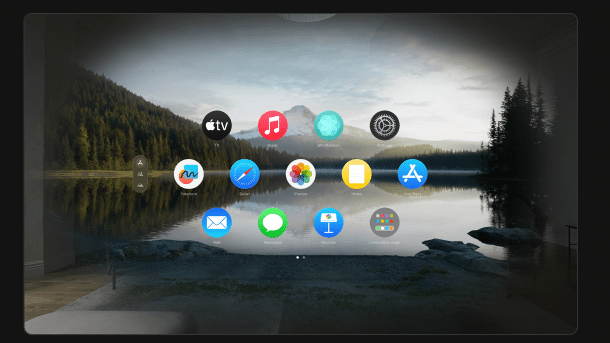

visionOS SDK mit Simulator.

(Bild: Apple)

- Gero Gerber

Bei der Vision Pro, die wir in einem eigenen heise+-Artikel ausführlich vorgestellt haben, handelt es sich um einen eigenständigen Spatial-Computer. Spatial deshalb, weil sich alles im Raum abspielt. Apps, Audio und Interaktion werden dreidimensional erfasst und wiedergegeben. An der Außenseite eingelassene Kameras erfassen Gesten und nehmen die Umgebung auf.

Dass der Nutzer durch die Brille seine Umgebung sehen kann, wird als Passthrough bezeichnet. Im Fall der Vision Pro kann man allerdings nicht tatsächlich durch die Brille hindurch sehen; stattdessen sieht der Headset-Träger seine Umgebung auf zwei Displays im Inneren des Headsets, wo sie sich gegebenenfalls mit anderen, eingespielten Inhalten wie Apps oder einer entfernten Umgebung vermischt. Passthrough kann mehr oder weniger eingeschränkt sein, je nach Kontext und Immersions-Stufe (wieviel der Nutzer von der realen Umgebung noch sieht). Die Steuerung erfolgt überwiegend mit der Stimme, Handgesten und per Augen-Tracking. Hierfür erkennt die Vision Pro, wenn der Nutzer etwa ein Objekt oder Steuerelement mit den Augen fokussiert.

Das Betriebssystem visionOS

Mit visionOS liefert Apple zur Vision Pro auch ein neues Betriebssystem. Den Vision Pro Simulator und das visionOS SDK laden registrierte Apple-Entwickler gemeinsam mit Xcode 15 herunter. Den Link sowie die Code-Beispiele aus diesem Artikel finden Sie wie immer im Webcode.

Das war die Leseprobe unseres heise-Plus-Artikels "Entwickeln für die Apple Vision Pro: So funktioniert das visionOS SDK". Mit einem heise-Plus-Abo können Sie den ganzen Artikel lesen.