ARKit 3 verbessert Immersion

Mit Motion Capturing, RealityKit und Reality Composer will Apple das AR-Erlebnis für Anwender und Entwickler verbessern.

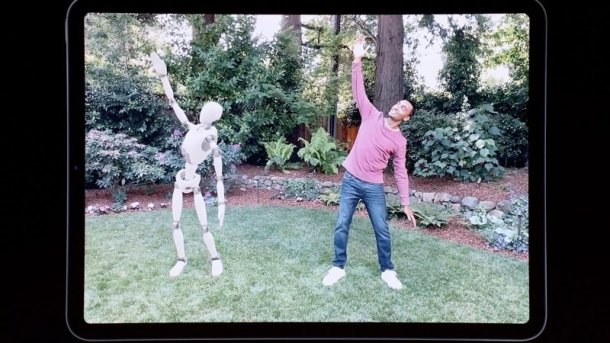

Mit dem ARKit 3 können Entwickler dank Motion Capturing erstmals menschliche Bewegungen einfangen und beispielsweise auf virtuelle Objekte in einer AR-Anwendung projizieren. Ebenso erlaubt es die Frontkamera, bis zu drei unterschiedliche Gesichter zu erkennen und eine App entsprechend reagieren zu lassen — beispielsweise wenn ein Spieler von einer virtuellen Figur berührt wird.

ARKit 3 (6 Bilder)

RealityKit

Zum ARKit 3 gehört außerdem das RealityKit. Dieses bietet unter anderem fotorealistisches Rendering, Physikeffekte, 3D-Sound, Animationen sowie Kameraeffekte und Bildrauschen. Entwickler sprechen das RealityKit über eine entsprechende Swift-API an.

Weiterhin gibt es mit dem Reality Composer eine App für alle Apple-Plattformen, mit der sich auch ohne bisherige 3D-Erfahrung ganz einfach AR-Inhalte erstellen lassen sollen. Per Drag&Drop-Oberfläche wählt der Anwender aus einer großen Mediathek 3D-Objekte und -Animationen aus und platziert respektive rotiert diese dann im Reality Composer. Das Ergebnis kann via Xcode direkt in eine App übernommen oder für AR Quick Look exportiert werden. (kai)