Fernfotografie durch den Smog

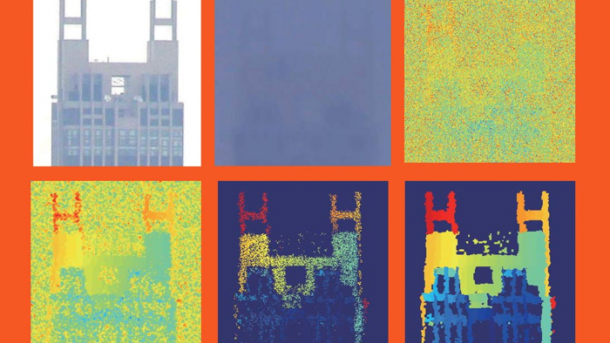

Ein Lidar-basiertes Bildgebungssystem aus China durchdringt Stadtsmog und bildet weit entfernte menschengroße Objekte ab.

(Bild: University of Science and Technology of China)

- TR Online

Langstreckenfotografie auf der Erde ist eine knifflige Herausforderung. Es ist nicht einfach, ausreichend Licht von einem Motiv in großen Entfernungen einzufangen. Hinzu kommt, dass die Atmosphäre Verzerrungen verursacht, die das Bild ruinieren können. Dies gilt auch für die Luftverschmutzung, die besonders in Städten ein Problem darstellt. Das machte Aufnahmen aus mehreren Kilometern Entfernung lange schwer. Seit einigen Jahren stehen Forscher allerdings Fotodetektoren zur Verfügung, die so empfindlich sind, dass sie einzelne Photonen aufnehmen und daraus Bilder von Objekten in einer Entfernung von bis zu zehn Kilometern zusammensetzen können.

Das wollten Zheng-Ping Li und Kollegen von der chinesischen Universität für Wissenschaft und Technologie in Shanghai noch weiter verbessern. Durch eine Kombination von Einzelphotonendetektoren mit einem Algorithmus für die rechnergestützte Bildgebung fügten sie weitgestreute Datenpunkte zu hochaufgelösten Bildern zusammen. Damit gelang es ihnen, Motive in einer Entfernung von bis zu 45 km in einer von Smog geplagten städtischen Umgebung zu fotografieren.

Die neue Technik ist im Prinzip relativ einfach. Sie basiert auf der optischen Abstands- und Geschwindigkeitsmessung (Light Detection and Ranging, kurz Lidar), bei der das Motiv mit Laserstrahlen beleuchtet und aus den reflektierten Lichtstrahlen ein Bild erzeugt wird. Der große Vorteil dieser aktiven Bildgebung besteht darin, dass die vom Objekt reflektierten Photonen innerhalb eines bestimmten, entfernungsabhängigen Zeitfensters zum Detektor zurückkehren. Alle Photonen, die außerhalb dieses Fensters eintreffen, können ignoriert werden. Dieses sogenannte "Gating" reduziert das Rauschen, das durch unerwünschte Photonen aus der Umgebung erzeugt wird, deutlich. Darüber hinaus macht es Lidar-Systeme sehr empfindlich und entfernungsspezifisch.

Geringe Leistung, sicher für die Augen

Zheng-Pings Team nutzte einen Infrarotlaser mit einer Wellenlänge von 1550 Nanometern, einer Wiederholungsrate von 100 Kilohertz und einer geringen Leistung von 120 Milliwatt. Diese Wellenlänge macht das System sicher für die Augen und ermöglicht es, Photonen herauszufiltern, die den Detektor sonst überfordern würden.

Das Senden und Empfangen dieser Photonen erfolgt über denselben optischen Apparat – ein gewöhnliches astronomisches Teleskop mit einer Apertur von 280 Millimeter. Die reflektierten Photonen werden anschließend von einem handelsüblichen Einzelphotonendetektor registriert. Um ein zunächst zweidimensionales Bild zu erstellen, scannten die Forscher das Sichtfeld mit einem piezogesteuerten Spiegel, der nach oben, nach unten und seitwärts geneigt werden kann.

Die dritte Dimension kam durch das Ändern der Gating-Zeiten hinzu, was auch das Aufzeichnen von Photonen erlaubt, die aus unterschiedlichen Entfernungen reflektiert wurden. Ein neu entwickelter Algorithmus fügte die Einzelphotonendaten zu einem 3D-Bild zusammen. Diese Art der rechnergestützten Bildgebung hat sich in den letzten Jahren rasant weiterentwickelt und es Forschern ermöglicht, Bilder aus relativ kleinen Datenmengen zu erstellen.

Passt in einen Schuhkarton

Das Gerät von der Größe eines großen Schuhkartons ist ziemlich gut tragbar. Das Team stellte die neue Kamera im 20. Stock eines Gebäudes auf der Insel Chongming in Shanghai auf und richtete sie auf das etwa 45 Kilometer entfernte Pudong Civil Aviation Building auf der anderen Seite des Flusses.

(Bild: University of Science and Technology of China)

Herkömmliche Bilder, die mit dem Teleskop aufgenommen wurden, zeigten lediglich Rauschen. Die neue Technik erzeugte jedoch Bilder mit einer räumlichen Auflösung von etwa 60 Zentimeter, wodurch sogar Gebäudefenster erkennbar waren. "Dieses Ergebnis zeigt die überlegene Fähigkeit des Nahinfrarot-Einzelphotonen-LiDAR-Systems, Ziele sogar durch Smog hindurch aufzulösen", so das Team.

Lesen Sie mehr zu Fotografie und Fernerkundung:

Das Ergebnis ist deutlich besser als die herkömmliche Beugungsgrenze von einem Meter bei 45 Kilometern und übertrifft auch andere kürzlich entwickelte Algorithmen. Das Bild hier zeigt das Potenzial der Technik in Bildern, die bei Tageslicht aus einer Entfernung von 21 Kilometern aufgenommen wurden. "Unsere Ergebnisse eröffnen einen neuen Einsatz für hochauflösende, schnelle und leistungsschwache optische 3D-Bildgebung über sehr große Entfernungen", sagt Zheng-Ping. Mögliche Anwendungen seien die Fernerkundung, die Luftüberwachung sowie die Zielerkennung und -identifikation.

()