Apple wirft Nacktbild-Schutzapp Nude raus

Angeblich störte sich der Konzern an der Beschreibung als “sexiest App ever”. Nude soll Nacktfotos des Nutzers automatisch schützen – lädt diese dafür unter Umständen aber auf Amazon-Server.

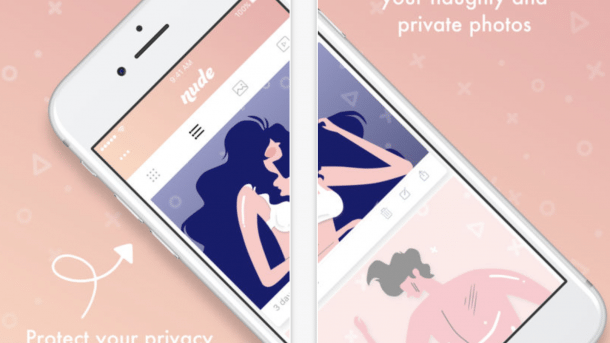

"Nude" – nach drei Wochen von Apple rausgeworfen.

(Bild: Entwickler)

Rund drei Wochen nach der Zulassung hat Apple die App “Nude” wieder aus dem App Store geworfen. Nude wollte Nacktfotos vor neugierigen Blicken schützen, indem diese automatisch erfasst, in der App gespeichert und anschließend aus der allgemeinen Fotomediathek sowie iCloud entfernt werden. In einer Begründung habe der Konzern zuerst darauf hingewiesen, dass das “Wegsperren von Fotos” nicht länger zulässig sei, erklärte die Mitgründerin des dahinter stehenden Start-ups gegenüber Inverse.

Apple will angeblich keine “sexiest App” im App Store

In einer anschließenden Kontaktaufnahme durch Apple habe das Unternehmen aber klargestellt, dass man sich nur an der Beschreibung als “sexiest App ever” störe. Ohne diese Zusatz könne die App unter dem Namen “Nude” wieder in den App Store.

Die Analyse der Fotos auf einschlägige Inhalte hin erfolgt mit Hilfe von Apples neuem Maschinenlern-Framework CoreML lokal auf dem Gerät. Das Framework gibt es allerdings nur in iOS 11. In älteren iOS-Versionen sendete die App die Fotos zur Nackt-Analyse stattdessen an Amazon-Server, inklusive der E-Mail-Adresse des Nutzers, wie ein Sicherheitsforscher kurz nach der Veröffentlichung der App warnte.

Nur Mini-Hinweis auf Amazon Rekognition

Der Anbieter der App wies im Beschreibungstext klein auf die Verwendung von Amazons Bilderkennungstechnik Rekognition hin, führte aber nicht explizit aus, dass die Fotos hochgeladen werden. Stattdessen wurde prominent versprochen, “nichts berührt die Cloud”. Ob Apple sich auch an dem Upload zur Bildanalyse störte, bleibt unklar – bislang ist Nude noch nicht wieder im App Store zu finden.

Als Geschäftsmodell setzte Nude auf ein Abonnement. Die App sei werbefrei, betonte der Anbieter. Die durch Machine Learning identifizierten Nacktbilder soll die App durch ein Passwort schützen, bei “Einbruchsversuchen” werde ein Foto des Angreifers aufgezeichnet. (lbe)