Robophilosophie: Darf man Roboter mit dem Hammer schlagen?

Werden Roboter zerstört oder getötet? Was denken Sie, wenn Sie sich nackt vor einen Roboter stellen? Empfinden Sie Scham? In Aarhus wird derzeit über diese Fragen diskutiert.

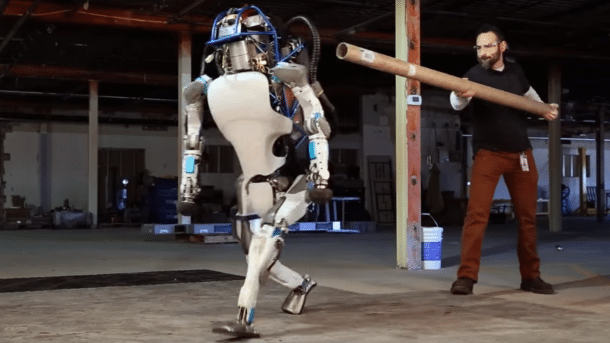

(Bild: Boston Dynamics)

Als „bewegliches Ziel“ beschrieb Christoph Bartneck (University of Canterbury) künstliche Intelligenz bei der internationalen Konferenz Robo-Philosophy in Aarhus. Der Neuseeländer meinte damit, dass mit künstlicher Intelligenz häufig genau die Dinge bezeichnet würden, die Computer (noch) nicht könnten. Dahinter steckt offenbar der verbreitete Wunsch, dass das menschliche Denken letztlich unerklärbar und die Grenze zwischen Mensch und Maschine unpassierbar bleiben möge. Allerdings nährte Bartnecks Vortrag nicht unbedingt die Hoffnung, dass dieser Wunsch erfüllt werden könnte.

Nackt vor dem Roboter

Wie menschlich Roboter und wie robotisch Menschen seien, hatte der Titel des Vortrags gefragt. Die Frage blieb auch am Ende unbeantwortet, was bei einer Philosophentagung nichts Ungewöhnliches ist. Dafür präsentierte Bartneck mehrere Studien, mit denen er versucht hat, herauszufinden, welche Bedeutung bei der Wahrnehmung von Robotern deren Menschenähnlichkeit hat.

Ein Experiment bestand darin, das Gefühl der Scham in verschiedenen Situationen zu ermitteln. „Schämen Sie sich, wenn Sie nackt vor der Waschmaschine stehen?“, fragte er die Zuhörer. „Wahrscheinlich nicht. Aber wie ist es, wenn Sie einem Roboter gegenüberstehen?“ Um das zu untersuchen, wurde im Experiment eine medizinische Untersuchung mit und ohne Roboter nachgestellt. Als Bartneck die Studie bei einer Konferenz vorstellen wollte, wurde sie jedoch aus ethischen Gründen abgelehnt: Die Probanden hatten vorher nicht über alle Aspekte des Experiments aufgeklärt werden können, etwa dass sie dabei gefilmt wurden. Zudem störten sich insbesondere einige US-Gutachter offenbar an der Nacktheit.

Robotertötung

Weniger Bedenken gab es dagegen bei einer Studie, die untersuchte, wie stark Menschen zögern, wenn sie aufgefordert werden, einen Roboter zu zerstören. Bartneck zeigte ein Video, in dem eine Frau noch einmal nachfragt, ob das wirklich der Wunsch des Versuchsleiters sei, bevor sie mit einem Hammer zuschlägt und dann mit den Worten „Das ist unmenschlich!“ das Labor verlässt. Die meisten Teilnehmer hätten gezögert, wenn sie einen Roboter, der mit ihnen sprach, ausschalten und sein Gedächtnis löschen sollten.

Empfohlener redaktioneller Inhalt

Mit Ihrer Zustimmung wird hier ein externes Video (TargetVideo GmbH) geladen.

Ich bin damit einverstanden, dass mir externe Inhalte angezeigt werden. Damit können personenbezogene Daten an Drittplattformen (TargetVideo GmbH) übermittelt werden. Mehr dazu in unserer Datenschutzerklärung.

Wurden die Roboter in diesen Experimenten zerstört – oder getötet? Die Wortwahl sei wichtig, betonte Bartneck. So würde etwa kein Verkäufer in einem Apple Store dem Kunden bestätigen, dass sein Smartphone „crashed“ sei, die offizielle Version laute vielmehr: „It stopped responding.“ Tatsächlich habe sich in einem weiteren Experiment gezeigt, dass auch Roboter im Dialog die Wortwahl von Menschen beeinflussen könnten. Die Wirkung war allerdings, wie auch bei den anderen Studien, geringer als im Kontakt mit anderen Menschen.

Subjekt schafft Objekt

Bemerkenswerterweise stützte sich Mark Coeckelbergh (Universität Wien), der im Anschluss an Bartneck sprach, zum Teil auf dieselben Studien. Neben wissenschaftlichen Untersuchungen zeigten aber auch künstlerische Installationen wie etwa Dancer #1 von Kris Verdonck, dass Menschen Empathie für vermeintlich leblose Objekte empfinden können. Es reiche nicht aus, etwa den Körper zu öffnen und ins Innere zu schauen, um zu entscheiden, ob es sich um einen Menschen oder einen Roboter handelt. Es sei immer das Subjekt, das das Objekt schaffe und seinerseits vom Objekt geformt werde, so Coeckelbergh. Dabei spiele auch die Sprache eine entscheidende Rolle: Bereits das Wort „Maschine“ enthalte eine Wertung. Die Sprache präge das Denken, es gebe keine neutralen Narrative.

Empfohlener redaktioneller Inhalt

Mit Ihrer Zustimmung wird hier ein externes Video (TargetVideo GmbH) geladen.

Ich bin damit einverstanden, dass mir externe Inhalte angezeigt werden. Damit können personenbezogene Daten an Drittplattformen (TargetVideo GmbH) übermittelt werden. Mehr dazu in unserer Datenschutzerklärung.

Coeckelbergh empfahl, nicht zu schnell zu urteilen und zu kategorisieren, weiter zu forschen, Erfahrungen zu sammeln und die Unsicherheit über die Ontologie und den moralischen Status von Robotern zu akzeptieren. Statt vorschneller Lösungen sei die Destabilisierung durch künstlerische Sichtweisen zu begrüßen. Es müsse Raum für Überraschungen und Unvorhersehbares geben. Das Design von Robotern müsse den Nutzern Raum für eigene Erkundungen lassen, das zukünftige Narrativ gemeinsam von Designern, Nutzern und Maschinen verfasst werden.

Kinder gestalten Roboter

In eine ähnliche Richtung zielt die Initiative des 2014 von Forschern an der Harvard University und dem Massachusetts Institute of Techology gegründeten Center for Children’s Speculative Design. Eine entscheidene Motivation dafür sei die Unzufriedenheit über Roboter gewesen, die für Kinder entwickelt wurden, ohne Kinder daran zu beteiligen, sagten Victor van den Bergh und David Robert bei der Vorstellung des Projekts. Mit bislang drei Programmen haben sie versucht, Methoden zu entwickeln, um Kinder als Co-Designer an der Entwicklung von Robotern zu beteiligen und Ideen zu entwickeln, „wie die zukünftige Welt aussehen könnte und aussehen sollte“.

(Bild: Hans-Arthur Marsiske)

Das Ergebnis des aktuellsten Programms kann bei der Konferenz besichtigt werden: Über hundert Kinder aus fünf Ländern (USA, Russland, Tansania, Dänemark, Deutschland) im Alter zwischen 7 und 14 Jahren haben ihre Vorstellungen von Robotern in Bild und teilweise auch Texten dargestellt (englische Übersetzungen der Texte finden sich hier. Die Ergebnisse sind teilweise deutlich durch mediale Repräsentationen geprägt, es zeigen sich aber auch kulturelle Unterschiede. So stellte Nadeshda Zilberman (Tomsk State University) in einer Befragung fest, dass russische Kinder Roboter viel stärker als Lebewesen wahrnehmen als Kinder in den USA.

In Russland hätten die Kinder komplette Biografien für Roboter entworfen, die völlig unabhängig von Menschen, teilweise zurückgezogen lebten. Das war ein Ergebnis, über das Zilberman selbst überrascht, aber offensichtlich auch erfreut war. Immerhin hat sich ja schon hier Coeckelberghs Wunsch erfüllt: Es gibt noch Raum für Überraschungen. (kbe)