IBM: "Quantenalgorithmus einfacher erklärbar als ChatGPT"

Scott Crowder, Vice President Quantum bei IBM über maschinelles Lernen auf dem Quantencomputer sowie Qualität und Quantität von Qubits.

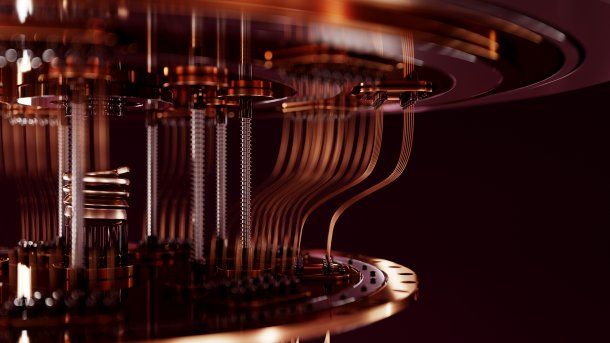

(Bild: Bartlomiej K. Wroblewski/Shutterstock.com)

Bisher haben Quantencomputer zwar immer noch nicht ihren praktischen Nutzen bewiesen. Es gibt aber extrem hohe Erwartungen in diese Technologie – vor allem in der Kombination von Quantencomputern und maschinellem Lernen – Quantum Machine Learning. Wie weit die Technologie ist, und wofür sie angewendet werden kann, erklärt Scott Crowder, Vice President Quantum bei IBM im Interview mit MIT Technology Review.

Wie weit ist IBM beim Quantum Machine Learning?

Lassen Sie mich damit beginnen, wo wir beim Quantencomputing stehen. Wir sind jetzt an einem Punkt angelangt, an dem wir Quanten-Systeme haben, die größer sind, als das, was man mit einem klassischen Computer simulieren kann. Jedenfalls nicht mehr mit klassischen Brute-Force-Methoden.

(Bild: IBM / Ryan Lavine)

Wir haben also das Zeitalter der Simulatoren hinter uns, so könnte die kurze Antwort lauten. Das ist dieses Jahr passiert. Es ist tatsächlich von Nutzen, eine Berechnung auf einem Quantencomputer durchzuführen, im Gegensatz zu einer Berechnung auf einem klassischen Computer oder einer klassischen Simulation.

Videos by heise

Das bedeutet aber noch nicht, dass Quantencomputing einen geschäftlichen Wert hat. Es bedeutet nur, dass ich diese Basisberechnung, die ich durchführen möchte, jetzt auf einem Quantencomputer effektiver durchführen kann als mit einer klassischen Simulation.

Das gilt auch für Bereiche wie das maschinelle Lernen, die in die gleiche Kategorie von Mathematik fallen und bei denen es einen exponentiellen Vorteil gibt, wenn man sie auf einem Quantencomputer ausführt.

Warum?

Grob gesagt, geht es um das Auffinden von Datenmustern, wenn die Daten eine komplexe Struktur aufweisen. Wir nutzen die höhere Dimensionalität von Quantencomputern, um Techniken des maschinellen Lernens zu entwickeln, die es ermöglichen, Muster auf eine andere Art und Weise zu finden, als dies mit klassischen Methoden möglich ist.

Es geht um Bereiche wie der Betrugserkennung, der besten Behandlung für einen Patienten auf der Grundlage elektronischer Gesundheitsdaten, der Erkennung von Mustern in der Kundenabwanderung zur Verbesserung der Kundenzufriedenheit und der Kundenbindung.

Wenn wir über maschinelles Lernen sprechen, sprechen wir über viele, viele Daten. Quantencomputing ist nicht dafür bekannt, dass es gut mit vielen Daten umgehen kann. Ist das ein Problem?

Ich gebe Ihnen ein Beispiel aus dem maschinellen Lernen. Beim maschinellen Lernen verwenden viele Leute eine Variante einer Support-Vektor-Maschine zur Klassifizierung. Der Trick dabei ist, dass man die Daten in eine höhere Dimension transformiert, damit die Maschine klassifizieren kann.

In der Quantentheorie kann man einen viel komplexeren Kernel erstellen. Man kann die Daten auf einen komplexeren Raum abbilden und eine Quantenhyperebene finden – wie auch immer man sich das vorstellen will –, um die Daten auf eine Art und Weise in Gut und Schlecht zu trennen, wie es auf klassischem Wege nicht möglich ist.

Wenn man Daten erhält, die man klassifizieren soll, ist das meist kein Big-Data-Problem. Die eigentliche Herausforderung bei der Implementierung besteht darin, dass unsere Quantencomputer zwar für einen Quantencomputer schnell sind, aber im Vergleich zu klassischen Computern immer noch langsam sind. Es kann also etwa eine Sekunde dauern, bis man das Ergebnis erhält, bis man weiß, ob es sich um ein falsches oder ein richtiges positives Ergebnis handelt. Aber in manchen Situationen, zum Beispiel wenn eine Kreditkarte durch einen Scanner gezogen wird, muss es viel schneller gehen.

Gemeinsam mit unseren Partnern versuchen wir daher, nicht nur den algorithmischen Teil zu verstehen, sondern auch die Frage, wie sich der Algorithmus in den Arbeitsablauf einfügt.

Kann man den Arbeitsablauf so ändern, dass man zum Beispiel nicht jede einzelne Kreditkartentransaktion durch den Quantencomputer schickt? Nur das, was ein klassischer Algorithmus für einen möglichen Betrug hält. In diesem Fall halten Sie den Zahlungsvorgang kurz an, und fünf oder sechs Sekunden später erhalten Sie das Ergebnis vom Quantencomputer und können daraufhin Maßnahmen ergreifen.

Wie viele Qubits braucht man, um in praktisch relevanten Fällen etwas zu klassifizieren?

Das hängt von dem Problem ab. Wenn man ein Problem auf einem Quantencomputer lösen will, gibt es zwei wichtige Messgrößen: die Breite, das heißt die Anzahl der Qubits, und die Tiefe, das heißt die Anzahl der Quanten-Gatter, die man ausführen kann. Die Rechentiefe hängt von der Art der Fehlerunterdrückung, der Fehlerkorrektur, der Qualität der Qubits und all diesen Dingen ab.

Der Durchbruch in diesem Jahr bestand darin, dass es uns gelang, die Fehlerrate so zu reduzieren, dass wir eine ausreichend lange Berechnung durchführen konnten, die einen echten rechnerischen Vorteil gegenüber einer klassischen Berechnung bietet. Wir sind der Meinung, dass die Breite des Schaltkreises für viele der maschinellen Lerntechniken wahrscheinlich nicht der begrenzende Faktor ist. Mit über 100 Qubits hat man bereits genug Variablen, um mit der klassischen Routinen mithalten zu können.

Aber unsere bisherigen Daten sind heuristisch. Wir müssen also weiter daran arbeiten, um zu verstehen, ob die Vorteile der Quantenmethode bei einer Skalierung von 16 Variablen auf 50 Variablen, 70 Variablen und 120 Variablen immer noch bestehen. Der Trend sieht gut aus, aber es gibt noch einiges zu tun.

Es tut mir leid, dass ich Ihnen eine sehr lange Antwort gebe, aber wir denken, dass Hunderte von Qubits für die meisten der Klassifizierungsbeispiele, die wir gesehen haben, ausreichen werden. Wir müssen nur in Zusammenarbeit mit unseren Kunden nachweisen, dass der Vorteil für ihren speziellen Datensatz bestehen bleibt.