Google öffnet Programmierschnittstelle für seinen Assistenten

Drittanbieter können ab sofort Googles Assistenten mit eigenen sogenannten Conversation Actions erweitern.

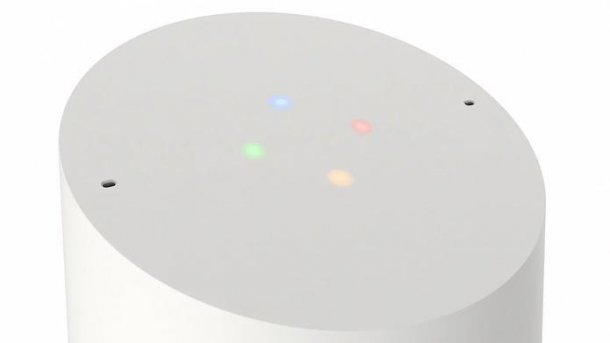

Google hat in seinem Entwickler-Blog bekanntgegeben, dass Entwickler jetzt eigene Erweiterungen für seinen Assistenten bauen können, sogenannte Conversation Actions. Bislang war das eingeladenen Partnern vorbehalten. Derzeit kann man Conversation Actions nur für den smarten Lautsprecher Home entwickeln, der derzeit nur in den USA verfügbar ist und nur Englisch spricht. Für den Messenger Allo und die Pixel-Smartphones, in denen ebenfalls der Assistent seinen Dienst verrichtet, soll das Feature bald verfügbar sein.

Entwickler sollen Konversationen soll mit den Werkzeugen von API.AI, das Google kürzlich übernommen hat, sowie mit Gupshup bauen können. Komplett fertig ist die Plattform noch nicht, es fehlen zum Beispiel noch Möglichkeiten, Käufe und Buchungen abzuwickeln.

Mit der neuen Plattform versucht Google, Boden beim Wettstreit mit Amazon gutzumachen. Amazon hatte seinen Assistenten Alexa von vornherein als offene Plattform konzipiert, für die Dritte Erweiterungen entwickeln können, die bei Alexa Skills heißen. Für die US-amerikanische Alexa gibt es mehr als 4000 Skills, für die deutsche Version, die erst seit Ende Oktober auf dem Markt ist, gibt es ein paar Dutzende. Googles Conversation Actions, so die Ankündigung, sollen sich einfacher nutzen lassen als Skills: Keine Installation, man soll sie einfach in der Form "Ok Google, talk to Number Genie" ansprechen können.

Die kommende c't berichtet ausführlich über Alexa, Googles Assistent und die anderen Assistenten Siri, Cortana und Sony Assistant, zeigt, wie man die Möglichkeiten von Google Home mit IFTTT erweitert, und wie man Skills für Alexa entwickelt. (jo)