Corona-Etikette: Maschinelles Lernen prüft Einhaltung von Abständen

Das Startup Landing AI hat ein neues Programm zur Hygieneüberwachung entwickelt, das warnt, wenn Menschen nicht die vorgeschriebene Entfernung einhalten.

- Karen Hao

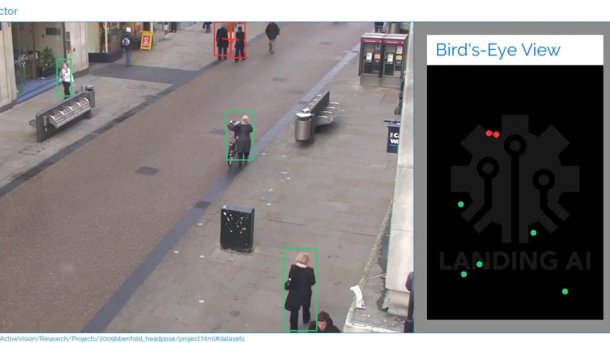

Mitte April veröffentlichte das Startup Landing AI einen Blog-Beitrag mit einem Video, das ein neues Werkzeug zur Überwachung der sozialen Distanzierung demonstriert. Auf der linken Seite sind in einem Video Fußgänger in einer Einkaufspassage zu sehen. Auf der rechten Seite stellt ein Vogelperspektivendiagramm die Menschen als grüne Punkte dar und färbt sie rot, wenn sie zu nah neben anderen laufen oder zu nah an jemandem vorbeigehen.

Videos by heise

Das Unternehmen gibt an, dass das Werkzeug für Arbeitsumgebungen wie Fabrikhallen vorgesehen ist und auf Anfrage seiner Kunden wie des taiwanesisches Elektronik-Auftragsherstellers Foxconn entwickelt wurde. Das Programm sei leicht in bestehende Sicherheitskamerasysteme zu integrieren. Allerdings prüfe man noch, wie Personen benachrichtigt werden können, wenn sie die vorgegebene soziale Distanz nicht einhalten. Eine Möglichkeit sei es, einen Alarm auszulösen, wenn Mitarbeiter zu nahe beieinanderstehen. Darüber hinaus könnten über Nacht erstellte Berichte den Managern helfen, bei Bedarf die Arbeitsbereiche umzuordnen, um das zu verhindern, sagt Landing AI.

Wie sieht das Werkzeug unter der Haube aus? Der Detektor muss zuerst kalibriert werden, um Sicherheitsaufnahmen auf die realen Dimensionen abzubilden. Ein zuvor trainiertes neuronales Netzwerk wählt dann die Personen im Video aus und ein anderer Algorithmus berechnet die Entfernungen zwischen ihnen.

Automatische soziale Distanzierung

Das Konzept der Arbeitsplatzüberwachung ist nicht neu. Anfang April berichtete die Nachrichtenagentur Reuters, dass Amazon eine ähnliche Software verwendet, um die Entfernungen zwischen seinen Lagerarbeitern zu überwachen. Das Werkzeug ergänzt auch eine wachsende Anzahl von Technologien, mit denen Unternehmen zunehmend ihre Mitarbeiter überwachen. Inzwischen sind unzählige billige KI-Systeme von der Stange erhältlich, um jeden Mitarbeiter in einem Geschäft zu beobachten oder jedem Kundendienstmitarbeiter bei Anrufen zuzuhören. Wie der Detektor von Landing AI melden diese Systeme Warnungen ebenfalls in Echtzeit, wenn Verhaltensweisen von einem bestimmten Standard abweichen. Die Coronavirus-Pandemie hat diesen Trend nur beschleunigt.

Die Technik führt auf heikles Territorium. In seinem Blog-Beitrag betont Landing AI, dass das Tool dazu gedacht ist, „Mitarbeiter und Gemeinschaften zu schützen“ und „mit Transparenz und nur mit Einverständniserklärung“ verwendet werden sollte. Dieselbe Technologie kann aber auch missbraucht oder verwendet werden, um schädliche Überwachungsmaßnahmen zu normalisieren.

Das Forschungsinstitut AI Now wies Ende 2019 in seinem Jahresbericht darauf hin, dass die Arbeitnehmer in den meisten Fällen wenig Macht haben, gegen solche Technologien Einspruch zu erheben. „Die Verwendung dieser Systeme“, so schrieb AI Now, „bündelt Macht und Kontrolle in den Händen der Arbeitgeber und schadet hauptsächlich Niedriglohnarbeitern, die zu einem überproportional hohen Anteil farbige Menschen sind.“ Anders ausgedrückt macht es ein bestehendes Machtgefälle noch schlimmer. (vsz)