Autonome Autos: Ethik durch Ergebnisse aus dem Fahrsimulator?

Mit einer neuen Studie wollen Osnabrücker Forscher zeigen, dass menschliches Handeln simulierbar ist. Das könnte für Software in autonomen Autos hilfreich sein.

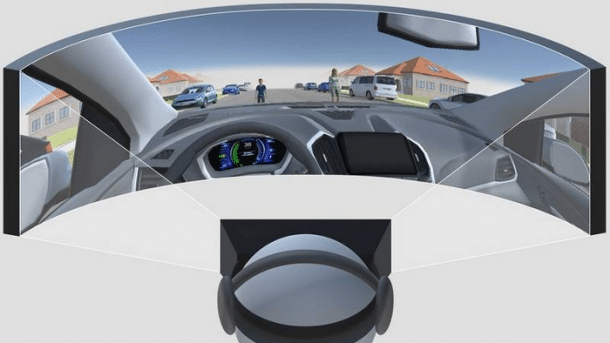

Probanden saßen am Steuer eines virtuellen PKWs, der in einem Vorstadt-Setting auf Hindernisse zufuhr. Eine Kollision war unausweichlich, es konnte lediglich die Spur ausgewählt werden.

(Bild: Universität Osnabrück)

- Marco Lehner

Forscher um den Kognitionswissenschaftler Gordon Pipa von der Universität Osnabrück haben eine Studie vorgestellt, die zeigen soll, dass Ethik und menschliches Verhalten in Extremsituationen von Maschinen simulierbar ist. Das berichtet Technology Review. Für ihre Untersuchung ließen die Wissenschaftler Probanden in einem VR-Fahrsimulator Platz nehmen. Die Studienteilnehmer fuhren durch eine neblige Vorstadtgegend und waren plötzlich mit Tieren und Menschen konfrontiert.

Lesen Sie dazu auch:

In einem Szenario hatten die Teilnehmer vier, in einem anderen nur eine Sekunde Zeit, um sich zu entscheiden, wohin sie ihr Auto lenkten. Hatten die Probanden vier Sekunden Zeit, versuchten sie durch ihre Handlung den aus ihrer Sicht geringsten gesellschaftlichen Schaden anzurichten. So wurden in diesem Szenario Männer eher überfahren als Frauen, Alte eher als Junge und Ziegen eher als Hunde. Hatten die Probanden jedoch nur eine Sekunde Zeit für ihre Entscheidung, blieben die Tendenzen zwar gleich, aber weniger stark ausgeprägt. Während im langsamen Szenario 80 Prozent aller Männer überfahren werden, sind es im schnellen nur noch 58 Prozent.

Nach Ansicht der Forscher sollten autonome Autos mit den Daten von Menschen in ähnlichen Situationen trainiert werden. Dadurch wären die Ergebnisse nachvollziehbar. Mit ihrem Vorschlag stehen die Osnabrücker den Anforderungen der Ethik-Kommission gegenüber. Diese ist der Ansicht, dass Entscheidungen, wie die Entscheidung Leben gegen Leben von der konkreten Situation abhängig sind. Sie seien deshalb nicht normierbar und auch nicht programmierbar. Die Kommission bezieht sich dabei darauf, dass die Schuldfrage erst im Nachhinein vor Gericht geklärt werden kann. Dort werden die äußeren Umstände miteinbezogen, die der Fahrer oder der Computer im Moment des Unfalls nicht wissen konnte. Deshalb könnten keine Regeln programmiert werden, die sich an gesetzlichen Normen orientieren.

Lesen Sie mehr dazu bei Technology Review:

Selbst ist das Auto (14 Bilder)

(Bild: Waymo)

(jle)