Roomba: Wie private Fotos eines Staubsauger-Roboters auf Facebook landen können

Der Hersteller des Roomba sieht die Schuld für Foto-Leaks nicht bei sich. Testnutzer hätten der Datenerfassung zugestimmt. Diese sehen das aber anders.

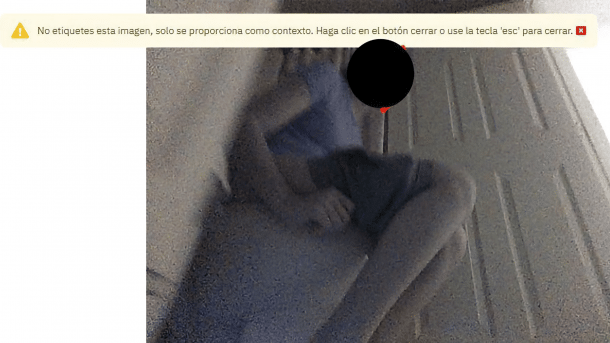

Mensch auf dem Klo, gefilmt von einem Roomba.

(Bild: Screenshot eines Roomba J7, Anonymisierung durch die US-Ausgabe von MIT Technology Review.)

- Eileen Guo

Als Informatiker Greg im Dezember 2019 seinen neuen Staubsauger-Roboter auspackte, dachte er eigentlich, er wüsste, worauf er sich da einlässt. Es handelte sich um eine Vorserienversion der Roomba J-Serie von iRobot. Neben seiner regulären Reinigungsarbeit sollte er im Haus umherstreifen, um alle möglichen Daten zu sammeln. Damit wiederum sollte das integrierte KI-System verbessert werden. Gleichzeitig hatte sich Greg verpflichtet, iRobot Feedback zu seiner Nutzererfahrung zu geben.

Das alles hatte er schon einmal gemacht. Neben seiner Arbeit als Ingenieur in einem Softwareunternehmen hatte Greg in den letzten zehn Jahren häufiger Beta-Tests von Produkten durchgeführt. Er schätzt, dass er in dieser Zeit über 50 Produkte getestet hat – von Turnschuhen bis hin zu Smart Home-Kameras. "Das macht mir wirklich Spaß", sagt er. "Der Grundgedanke ist, dass man etwas Neues kennenlernt und hoffentlich an der Gestaltung eines Produkts mitwirkt, sei es bei der Entwicklung einer besseren Version oder bei der Festlegung der Funktionen."

Videos by heise

Was Greg jedoch nicht wusste – und seiner Ansicht nach auch nicht erlaubt hatte – war, dass iRobot die Daten von Testnutzerinnen und -nutzern wie ihm an eine weitläufige, globale Lieferkette weitergeben würde. Die wiederum besteht offenbar vor allem aus schlecht bezahlten Beschäftigten außerhalb der USA, die sämtliche Bilder (und jede gefilmte Person) einsehen können, die von den Frontkameras des Staubsauger-Roboters aufgenommen wurde. Und, noch schlimmer: Einige dieser Menschen machen von den Aufnahmen offenbar nach Belieben Screenshots, die dann weitergegeben werden.

Ein Roomba auf Abwegen

Greg, der darum gebeten hat, nur mit seinem Vornamen genannt zu werden, weil er eine Geheimhaltungsvereinbarung mit iRobot unterzeichnet hat, ist nicht der einzige Testnutzer, der sich betroffen und überrascht zeigt. Fast ein Dutzend Personen, die zwischen 2019 und 2022 an dem Programm teilgenommen haben, zeigten sich nach einer Recherche der US-Ausgabe von MIT Technology Review erstaunt darüber, dass das Unternehmen Bilder aus ihren realen Wohnungen verwendet, um seine KI zu trainieren. Sie äußerten Bedenken, wie iRobot mit diesen Daten umgeht und fragen sich, ob diese Praktiken mit den Datenschutzversprechen des Unternehmens übereinstimmen. Viele fühlen sich getäuscht.

"Es besteht eine echte Besorgnis darüber, ob das Unternehmen betrügerisch handelt, wenn Menschen sich für diese Art von hochgradig invasiver Überwachung anmelden und nie ganz verstehen, wozu sie sich bereit erklären", kommentiert Albert Fox Cahn, Geschäftsführer des "Surveillance Technology Oversight Project", das sich für mehr Datenschutz engagiert. "Das Versäumnis des Unternehmens, die Daten der Testnutzer angemessen zu schützen, fühlt sich wie ein klarer Bruch der Vereinbarung auf ihrer Seite an", sagt Greg. Es sei "ein Versagen ... [und] auch ein Vertrauensbruch". Anders gesagt: Wer übernimmt hier die Verantwortung?

MIT Technology Review konnte aufdecken, wie iRobot Fotos und Videos aus den Wohnungen von Testnutzern und Beschäftigten sammelt und sie an Unternehmen weitergibt, die KI-Modelle durch sogenannte Etikettierung mit Daten füttern. Dabei werden Bildbereiche markiert und von Menschen beschriftet, die Algorithmen so trainiert. Zu den beteiligten Firmen gehört das in San Francisco ansässige Unternehmen Scale AI, das über den Globus verstreut lebende Beschäftigte damit beauftragt, diesen Job zu erledigen.

Roomba-Fotos finden ihren Weg ins Internet

Bei der Recherche kam etwa heraus, dass bei einem Projekt im Jahr 2020 prekär beschäftigte "Gigworker" in Venezuela gebeten wurden, Objekte in einer Reihe von Bildern von Innenräumen zu beschriften, von denen einige auch Personen enthielten – deren Gesichter für die Gigworker sichtbar waren. Einige der Beschrifter teilten dann mindestens 15 Bilder – darunter Aufnahmen eines Minderjährigen und einer Frau, die auf der Toilette sitzt – in sozialen Medien, wo sie sich darüber austauschten. Diese Screenshots landeten schließlich in der US-Redaktion von MIT Technology Review. Es folgten Interviews mit den Gigworkern. Auch Rückfragen bei KI-Forschern, die sich mit dem Thema befassen, lassen vermuten, dass dies wahrscheinlich nicht die einzigen Bilder sind, die ihren Weg ins Internet gefunden haben.

Dass sensible Bilder, Videos und Audiodateien Menschen vorgesetzt werden, die mit der Etikettierung zu KI-Zwecken beschäftigt sind, kommt mittlerweile häufiger vor. Und kurz nachdem MIT Technology Review iRobot im vergangenen Herbst um eine Stellungnahme zu den Fotos gebeten hatte, kündigte das Unternehmen seinen Vertrag mit Scale AI. In einem LinkedIn-Posting in Reaktion auf die Berichterstattung wollte iRobot-CEO Colin Angle allerdings nicht bestätigen, dass die bloße Tatsache, dass solche Bilder mitsamt der Gesichter der Testnutzer für Gigworker sichtbar waren, ein Grund zur Sorge sei. Vielmehr schrieb er, dass die Bereitstellung solcher Bilder notwendig ist, um die Objekterkennungsalgorithmen von iRobot zu trainieren.

"Wie werden unsere Roboter so smart? Es beginnt während des Entwicklungsprozesses und auch durch die Sammlung von Daten zum Trainieren von Algorithmen aus dem Bereich des maschinellen Lernens." Außerdem wies er darauf hin, dass die Bilder nicht von Kundinnen und Kunden stammten, sondern von bezahlten Testnutzern ("paid data collectors") und Mitarbeitern. Und die hätten ja eine Einverständniserklärung unterzeichnet.

In dem LinkedIn-Post und in weiteren Erklärungen gegenüber MIT Technology Review haben Angle und iRobot wiederholt betont, dass keine Kundendaten weitergegeben wurden und dass die Teilnehmenden informiert wurden und ihnen bewusst ist, wie die Daten gesammelt werden. Der Versuch, zwischen Kunden und Testnutzern zu unterscheiden, verwirrt jedoch letztere. Denn sie betrachten sich als Teil der breiteren iRobot-Community und fühlen sich herablassend behandelt. Greg und die anderen Betroffenen, die sich gemeldet haben, bestreiten zudem, durch die freiwillige Teilnahme ihre Privatsphäre aufgegeben zu haben. Das sei eine Unterstellung.