Autonome Autos: Fahren nach Gefühl

Assistenzsysteme sollten so fahren, dass sich Nutzer wohlfühlen. Forscher arbeiten an Autos, die sich auf die emotionalen Bedürfnisse ihrer Insassen einstellen.

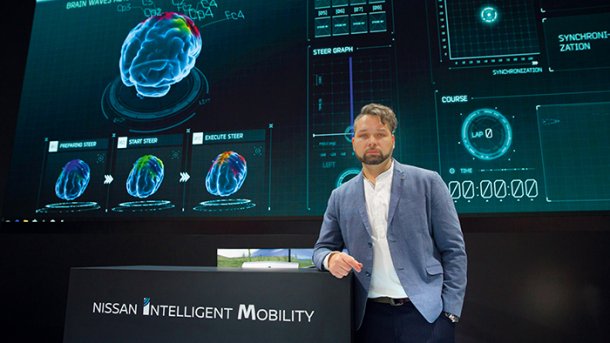

(Bild: Nissan)

- Frank Puscher

Den perfekten Chauffeur will Nissan gemeinsam mit der École Polytechnique in Lausanne erschaffen. Dies berichtet das Magazin Technology Review in seiner aktuellen Ausgabe 6/2019 (jetzt am Kiosk oder hier zu bestellen). Dazu wollen die Forscher zunächst verstehen, was im Gehirn eines Fahrers oder eines Mitreisenden während der Fahrt vor sich geht. Zu diesem Zweck haben sie unter anderem ein extrem genaues EEG-Headset sowie robuste Algorithmen entwickelt. Mit ihnen lassen sich Gehirnströme auch in dynamischen Umgebungen wie fahrenden Autos auswerten – oder in Fahrsimulatoren, wo Störungen gezielt eingeblendet werden.

Mittlerweile haben die Forscher viele Hundert Probanden im Simulator untersucht. "Wir haben dabei ein Muster im EEG identifiziert, das wir Error Related Potential nennen", sagt Lucian Gheorghe, der das Forschungsprojekt "Brain to Vehicle" bei Nissan leitet. Allerdings kann man daraus noch nicht auf konkrete Emotionen schließen – Stress schlägt sich im EEG genauso nieder wie Freude. Und für Stress wiederum kann ein zu forsches oder ein zu zögerliches Fahren ausschlaggebend sein.

Software merkt, wem die Musik nicht gefällt

Um trotzdem an so etwas wie "Wohlfühldaten" zu kommen, nutzen die Forscher eine Art Rechentrick: Sie unterstellen, dass ein Autopilot oder ein Fahrassistent keinerlei positive Abweichungen verursacht. Also ist jeder Ausschlag im ERP Ausdruck von Stress. Ziel beim Feintuning des Systems ist es deshalb, so etwas wie eine "emotionale Nulllinie" zu erreichen. Nach dem Trial-and-Error-Prinzip drehen die Forscher so lange an Parametern wie Beschleunigung und Lenkausschlägen herum, bis sich die ERP-Ausschläge im Simulator minimieren. "Die Ergebnisse unserer Forschung fließen in die nächste Generation der Assistenzsysteme bei Nissan ein", sagt Lucian Gheorghe.

Um das Befinden der Insassen in Echtzeit zu erfassen, sind solche Headsets allerdings zu umständlich. Doch auch dafür gibt es Lösungen: Kameras im Innenraum nebst Software zur Emotionserkennung. Als führend gilt das US-amerikanische Start-up Affectiva, deren System heute zur Müdigkeitserkennung eingesetzt wird. Aber es dürfte kein allzu großer Schritt sein, damit das Befinden der Insassen zu ermitteln – und das Auto vorsichtiger fahren zu lassen, wenn ihnen offenkundig übel ist. Laut Affectiva merkt die Software sogar, wenn etwa einem Beifahrer die Musik nicht gefällt.

Den kompletten Beitrag lesen Sie in der neuen Juni-Ausgabe der Technology Review (im gut sortierten Zeitschriftenhandel und im heise shop erhältlich. (grh)